Leetcode Temporary

本页面已经停止维护,并将不断删除内容,直到全部内容删除完毕为止。今后不再做一道题记录一道题,而是只记录重要的题到我的roadmap中。

No.1 - No.50

1. Two Sum

这道题非常经典,是leetcode第一题。用hashmap存放{本数的补数:本数的index}。

2. Add Two Numbers

这道题也非常经典。要注意最后剩下cur1,cur2或者carry的情况,可以三个情况合并为一个循环:

while cur1 or cur2 or carry:

val1 = cur1.val if cur1 else 0

val2 = cur2.val if cur2 else 0

3. ※ Longest Substring Without Repeating Characters

经典滑动窗口题,这道题建议强行记忆。

这里注意,string不能用类似set或者hashmap的直接判断方法,所以需要记录有没有、存在不存在的题,都需要设置set或者hashmap来记录存在与否,而且这样也能保证查询的时间复杂度是O(1)。

这里要注意,左指针跳跃的条件是判断其最新位置是否在当前子字符串范围内,这个技巧非常聪明。

i是左边界,需要根据情况调整

for right in range(len(string)):

检查当前字符是否在hashmap中:

如果在,则判断其最新位置是否在[i,j]之间:

如果在之间,则表明新字符是一个重复字符,不能记录

移动i到该位置的下一个位置

记录当前最大值max_len

最佳实践:

class Solution(object):

def lengthOfLongestSubstring(self, s):

if not s:

return 0

occurd = {}

left = 0

max_len = 0

for right in range(len(s)):

cur_char = s[right]

if cur_char in occurd and occurd[cur_char] >= left:

left = occurd[cur_char] + 1

occurd[cur_char] = right

max_len = max(max_len, len(s[left:right+1]))

return max_len

...

...

6. Zigzag Conversion

这道题初见较难。如果考虑行列和形状,会导致解法变得复杂。正确思路应该是直接生成对应的行,然后分析当前遍历字符应当处于哪一行,按顺序添加进去。

难点:向上放置的时候,应放行数 = cycle_len - cycle_index,可以想象循环最终一定是在第一行,因此在向上部分,应放行数就等于循环终点 + 离终点的距离。

7. Reverse Integer

主要考察: (1)%10:取出末尾数字 (2)//10:移除末尾数字 (3)整数溢出: 最小32位负数是 -2*31,最大32位正数是231-1 那么如何在溢出之前检查呢? 这里的技巧是: 如果number = number * 10 + last_digit > MAX_INT 那么数学公式变换后就是: if number > (MAX_INT - last_digit)//10: return 0

class Solution:

def reverse(self, x: int) -> int:

# 定义32位整数范围的最大值

INT_MAX = 2**31 - 1

result = 0

sign = 1 if x >= 0 else -1

x = abs(x)

while x != 0:

digit = x % 10

# --- 这是最关键的检查 ---

# 在执行 result * 10 之前,预判是否会溢出

# INT_MAX // 10 的值是 214748364

if result > INT_MAX // 10 or (result == INT_MAX // 10 and digit > 7):

return 0 # 如果会溢出,立即返回 0

# --- 检查通过,可以安全地执行 ---

result = result * 10 + digit

x //= 10

return sign * result

...

...

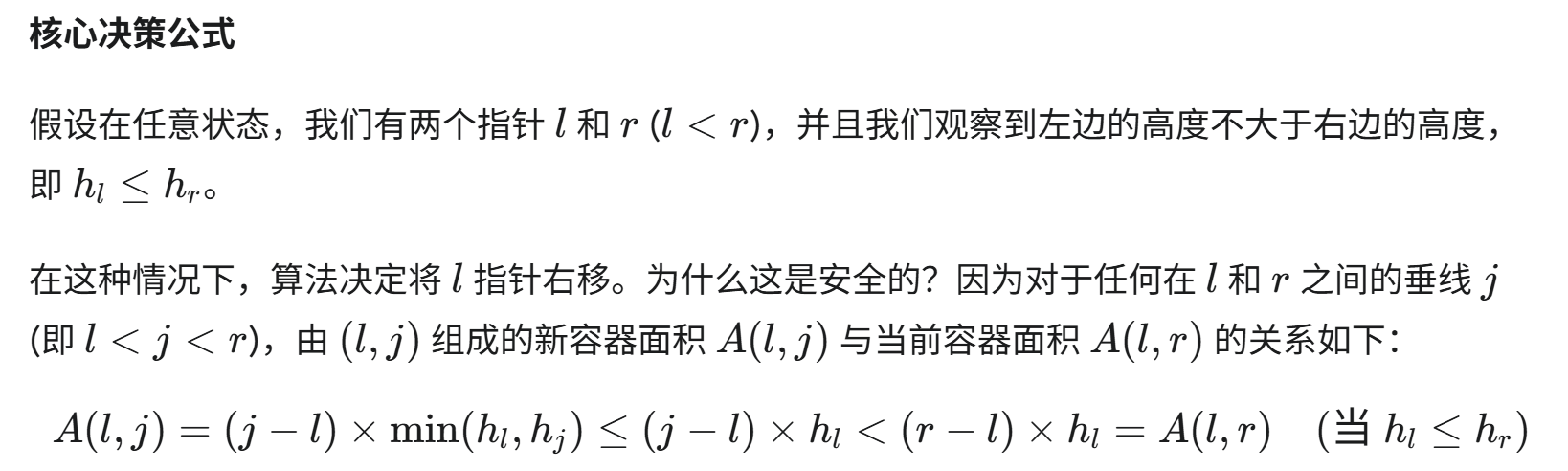

11. Container With Most Water

初见:没想出来非暴力解法。

左右指针相向而行,高度更小的指针移动。这个解法如何保证不会遗漏更大的解呢?——这便是这道题非常重要的思想:缩减搜索空间。

这是一种非常聪明的剪枝(Pruning)策略。

12. Integer to Roman

The intuitive solution is to set a value list and a roman symbol list, and then perform // and % on the number num to be converted in turn, but it is difficult to handle special values here.

Based on the intuitive solution, make a slight modification, put the special value into the value list, and then subtract this value in turn to get the answer.

New python gramer: value_symbol = [(1000, 'M), ... This is the list of tuples. Equals to two lists. When you traverse it, use for value, symbol in value_symbol:.

...

13. Roman to Integer

Use a dict/map store roman numbers.

Start from right, if left one is smaller, then sub; else sum.

New python grammer: for s in reversed(str) means traverse in reversed order.

14. Longest Common Prefix

这道题初见感觉很简单,很容易想到直观解法(纵向扫描):从每个单词的第一个字母开始对比,一直对比到出现不同的字母为止。coding的时候有一个技巧:总是把第一个单词作为基准去比较。

这道题初见直观解已经是最高效的了,时间效率O(N*P),空间效率O(1)。

如果用字典序的方法去排序的话,会导致时间和空间复杂度提升,得不偿失。

15. 3Sum

初见:没想出来。提示后想到把这道题分解为twosum,只是twosum的和的标准是和nums列表一样长的一个基准序列。换句话说,把3sum题转换为一个长度为N的2sum题。

注意:2sum需要先对列表进行排序,python自带的 .sort()的时间效率是

解法:

已知nums数列,对nums排序

基准参数k:for k in range(len(nums)-2):

对于每个参数k所对应的有序列表,进行2sum经典解法(左右双指针)

这里注意,2sum的范围是k后面的区域

指针移动时跳过连续重复数字,因为nums已经排序,所以相当于防止重复结果(这是最佳去重的实践方法)

时间:O(N^2),空间:O(N)

python coding注意:.sort()是原地修改。

这道题是一个经典的3SUM问题,长期以来一直被认为其复杂度下限就是O(N^2),不过在科学家们的努力下,该问题如今被压缩到亚二次方(sub-quadratic)级别了;但是,优化改进仅推翻了强3SUM猜想,但是依然无法撼动弱3SUM猜想,即不存在时间复杂度为\(O(N^{2-\epsilon})\)的算法(其中epsilon为大于0的常数):

4SUM问题(3SUM基础上提升)

4SUM问题不能直接用同样的方式去降维,转而可以使用空间换时间的方法,让时间复杂度同样为O(N^2),代价是牺牲空间,让空间复杂度为O(N^2)。4SUM详见下一道题。

17. Letter Combinations of a Phone Number

初见过,第一次提交测试发现path设置为''会报错,于是就改成记录为list,然后用''.join(path)把list修改为字符串的方式通过测试。查了下string在python中是不可变对象(immutable object),一旦创建其内部状态的值就不能被改变,所以一定不要用string来当作path,用list很方便。

作为第一道初见过的回溯,并且Beats 100%,我非常高兴!纪念一下我的代码(2025/07/15):

class Solution(object):

def letterCombinations(self, digits):

if not digits:

return []

# input: ONLY 2-9, so don't need consider 1, 0, *, #

# output: according to input, output is all possible combination letters

# for example

# digit = "2"

# choices = ["a","b","c"]

# digit = "23"

# choices = [

# ['a','b','c'], first choose one from this row

# ['d','d','f'] then choose one from this row

# ]

result = []

path = []

hashmap = {

"2": ["a","b","c"],

"3": ["d","e","f"],

"4": ["g","h","i"],

"5": ["j","k","l"],

"6": ["m","n","o"],

"7": ["p","q","r","s"],

"8": ["t","u","v"],

"9": ["w","x","y","z"]

}

def backtrack(cur_index):

if len(path) == len(digits):

path_str = ''.join(path)

result.append(path_str)

return

cur_letter = digits[cur_index]

choices = hashmap[cur_letter]

for choice in choices:

path.append(choice)

backtrack(cur_index+1)

path.pop()

backtrack(0)

return result

...

...

18 ※ 4Sum

Solution1: Demension Reduction (This can pass leetcode)

Reduce demensions, Time: O(N^3), Space: O(1)

nums.sort()

for i in range(len(nums)-3):

for j in range(i+1, len(nums)-2):

left = j + 1

right = len(nums) - 1

use 2Sum to find the required pairs

More specifically:

class Solution(object):

def fourSum(self, nums, target):

if len(nums) < 4:

return []

nums.sort()

result = []

for i in range(len(nums)-3):

if i > 0 and nums[i] == nums[i-1]:

continue

for j in range(i+1, len(nums)-2):

if j > i+1 and nums[j] == nums[j-1]:

continue

left = j + 1

right = len(nums) - 1

while left < right:

if nums[left] + nums[right] + nums[i] + nums[j] < target:

left += 1

elif nums[left] + nums[right] + nums[i] + nums[j] > target:

right -= 1

else:

result.append([nums[i],nums[j],nums[left],nums[right]])

while left < right and nums[left] == nums[left+1]:

left += 1

while right > left and nums[right] == nums[right-1]:

right -= 1

left += 1

right -= 1

return result

.

Solution2: Hashmap (This cannot pass leetcode in extreme testcase)

Time: O(N^2), Space: O(N^2)

find sum of all two-numbers, make this problem into find 2 two-sum

traverse the dict, find two pairs that meets the requirement

lastly, eliminate the duplicates

More specifically:

if len(nums) < 4:

return []

from collections import defaultdict

sum_map = defaultdict(list)

for i in range(len(nums)-1):

for j in range(i+1, len(nums)):

sum_map[(nums[i]+nums[j])].append((i,j))

result_set = set()

for s1 in sum_map:

s2 = target - s1

if s2 in sum_map:

pairs1 = sum_map[s1]

pairs2 = sum_map[s2]

for(a,b) in pairs1:

for(c,d) in pairs2:

if b < c: # because when we create pairs, a < b and c < d

quad = tuple(sorted([nums[a],nums[b],nums[c],nums[d]]))

result_set.add(quad)

return [list(q) for q in result_set]

Why cannot pass leetcode: if the input nums is [2,2,2,2,2,2,2,2,2,2,2,...], then the hashmap will only have one key: 4. This cause the performance of the lookup phase to degenerate from near constant time to a staggering O(N^4)

..

19. Remove Nth Node From End of List

这道题初见立马就想到用两个指针,差开N+1的距离,然后找到Nth Node了,但是要注意处理一个特殊的边界情况:如果第一个节点就是要删除的节点呢?

所以这道题一定要引入一个dummy虚拟头节点,然后让fast和slow同时从虚拟头节点开始。

虚拟头节点在linked list中一定要多用、常用,这是一个非常实用并且robust好的实践方法。

...

20. ※ Valid Parentheses

这道题是学习stack的一道题,如果还没做过stack的题建议认真做,然后全文背诵。

class Solution(object):

def isValid(self, s):

"""

:type s: str

:rtype: bool

"""

hashmap = {

")" : "(",

"]" : "[",

"}" : "{"

}

stack = []

for char in s:

if char in hashmap:

if not stack:

return False

cur_stack_top = stack.pop()

if cur_stack_top != hashmap[char]:

return False

# the stack top is already pop

else:

stack.append(char)

# if stack is empty: return True

return not stack

【括号系列第一题】下一道题:22. Generate Parentheses

...

...

22. ※ Generate Parentheses

在20中,我们使用stack来validate parentheses,这道题我们来看generate parentheses。这道题也非常经典,如果不熟悉这个算法思路一定要记住。

回溯(左括号数量,右括号数量,path):

basecase:path长度达到要求

如果左括号数量还没达到上限:(left < n)

回溯( 左括号数量+1,右括号数量,path+"(" )

如果右括号数量小于左括号的数量:(right < left)

回溯( 左括号数量,右括号数量+1,path+")" )

【括号系列第二题】下一道题:22S. Generate Parentheses Plus

22S. Generate Parentheses Plus

如果我们把上导体的一种可选括号,改为三种可选括号,其他题目不变,那么这道题将无法用简单的计数方式来解决,从而需要一个显式的stack来实现validation机制(即20. Valid Parentheses的验证方法)。

【括号系列第三题】下一道题:32. Longest Valid Parentheses (Hard)

23. Merge k Sorted Lists (Mark)

这道题是heap题。

暴力解法O(N*K)如下:

# Definition for singly-linked list.

class ListNode(object):

def __init__(self, val=0, next=None):

self.val = val

self.next = next

class Solution(object):

def mergeKLists(self, lists):

"""

:type lists: List[Optional[ListNode]]

:rtype: Optional[ListNode]

"""

# 创建一个虚拟头节点,简化代码

head = ListNode()

current = head

while True:

smallest_node_val = float('inf')

smallest_node_index = -1

# 1. 遍历所有链表的当前头节点,找到最小的那个

# 这个 for 循环实现了你的 "每一轮要把ls中的所有的node拿出来作比较!" 的思路

for i in range(len(lists)):

if lists[i] and lists[i].val < smallest_node_val:

smallest_node_val = lists[i].val

smallest_node_index = i

# 2. 如果 smallest_node_index 仍然是 -1,说明所有链表都已经是 None 了

# 这实现了你的 "直到lists中所有元素都为空" 的退出条件

if smallest_node_index == -1:

break

# 3. 将找到的最小节点接到结果链表的末尾

# 这实现了你的 "把smallest_node这个节点放到cur_new的下一个上"

current.next = lists[smallest_node_index]

current = current.next

# 4. 将那个链表的头指针向后移动一位

# 这实现了你的 "把smallest_node这个节点进行移动"

lists[smallest_node_index] = lists[smallest_node_index].next

return head.next

...

...

...

26. Remove Duplicates from Sorted Array

two pointers.

27. Remove Element

这道题在循环设置上容易出错:

while i <= j: # 注意这里是小于等于

if nums[i] == val and nums[j] != val: ...

elif nums[i] == val and nums[j] == val: ...

else: ...

...

...

28. Find the Index of the First Occurence in a String

这个算是一个pyton技巧学习题,找到字符串中对应的单词的方法:string.find(word),返回对应index。python底层在搜索字符上用的是Boyer-Moore-Horspool 算法,感兴趣的人可以看看相关资料。

...

...

30. Substring with Concatenation of All Words (Hard)

这道题题目看了半天硬是没明白想要我干啥。简单来说就是,给定一个string和一个list,寻找string中有几个包含list中给定的单词组成的字符串,并return这些字符串的开始位置。并且,最重要的是,list中给定的单词长度一致,这个条件如果漏掉这道题就做不了了。我一开始想了半天,最后才发现words里的候选词长度一样,难度直接降低了一百倍。

折腾了半天之后用下列算法做了出来:

set a hashmap, 记录words中单词和出现次数

设置一个长度相当于words中单词总长的window

对string进行遍历,从头start开始,到len(s)-window_size结束:

设置一个临时的hashmap

对当前窗口进行遍历,每步递进一个word的长度:

获得当下的cur_word

如果cur_word不在hashmap中,break

将cur_word计入临时hashmap中

如果cur_word出现次数超过hashmap中的记录次数,break

对比临时的hashmap和hashmap:

当且仅当两者完全一样的时候:

记录当前的start

我的这个解法可以通过leetcode,但是效率有点低。最大的问题就是对每个窗口,都完全重新切分依次。

我的解法时间效率是O(N*M),N是字符串长度,M是窗口大小。

优化思路是进行多个起始点,比如假设word长度是5,那么就分别以第一个字母、第二个字母、...、第五个字母为起始点。这样做的好处是,每次窗口移动的时候可以移动5个字符量,而不需要每个都移动。

这样修改后,外部循环的次数还是O(N),但是内部不需要对每个窗口重新切了,因为不需要考虑类似'xtodayidkjsf'中把today给忽略掉的情况,因为五个出发点总有一个能考虑进去。所以内部循环每次只需要把左边踢出去的单词在临时hashmap中去掉,然后把右面新进入的加进来,就可以了。这样子内部的O(M)的平均时间复杂度就降低了,计算的话总共要O(N)次操作,摊销到每个子cur_word不过O(1)。

30S. Substring with Uncertain Words (SuperHard)

给定一个字符串 s 和一个字符串数组 words,其中 words 中各单词长度 不一定相同 。定义一个 “连接子串” 为将 words 中每个字符串恰好出现一次、按任意顺序拼接而成的串。请返回所有 s 中恰好是某个“连接子串”的起始索引。答案可以按 任意顺序 返回。

...

31. Next Permutation

注意:这道题跟回溯中的Permutation排列的解法没关系!这道题本质上是在考察对排列本质的理解。这道题直接记住思路就可以了。

限制条件:

- 必须原地修改

- constant extra memory,常数级别的额外空间

换句话说,就是不能创建一个新的result。

这道题有一个特别的解法,可以学习一下:

- 以[1, 3, 5, 4, 2]为例,目标是找到比这个数字字典序大一位的下一个数

- 从右往左看,[5, 4, 2]这个部分是降序的,无论如何都无法更大了

- (追加判断)这里要注意,如果从头到尾都找不到较小数,或者说整个数列就是降序的,那么这个数字就是最大数;这个数字的下一个就是整个数组翻转过来的最小数。

- 再往左看一个数字,3比5小,出现了爬坡的趋势,这个3就是我们要找的那个需要被变大的数,我们称之为“较小数”(smaller number);找到smaller number以后记得break循环,结束查找。

- 我们再看3的右边的数字,我们要从3的右边找到一个比3大的最少的那个数字,我们称为较大的数(larger number)

- 从右向左遍历3右边的序列[5, 4, 2],找到第一个比3大的数,这个数是4。

- 交换smaller number 3和larger number 4

- 交换后得到[1, 4, 5, 3, 2]

- 交换后观察4右边的序列,发现不是最小的数,最小的序列应该是[2, 3, 5]

- 对4右边的序列进行升序排序

- 完成下一个字典序数字的寻找

...

...

...

32. ※ Longest Valid Parentheses (Hard)

三种解题思路:动态规划,stack,two pointers;后两个比较巧妙。

首先是stack方法:这是最直观和最巧妙的解法之一。

- 思路: 我们用一个栈来存储 左括号的索引 。

- 为了处理边界情况(例如 "()" 这种从头开始就有效的子串),我们先在栈里放一个

-1作为“哨兵”。 - 遍历字符串:

- 遇到

'(',将其索引压入栈。 - 遇到

')',弹出栈顶元素。 - 如果弹出后栈为空,说明当前的

')'没有匹配的'(',我们将这个')'的索引压入栈,作为新的“哨兵”。 - 如果弹出后栈不为空,则当前有效子串的长度就是当前索引

i减去 栈顶的新索引 。我们用这个长度更新最大长度。

- 遇到

- 时间复杂度: O(N)

- 空间复杂度: O(N)

另一个方法和思路是Two Pointers,这是一个空间复杂度最优的解法:

- 思路:

- 从左到右遍历字符串,用两个计数器

left和right分别记录(和)的数量。 - 当

left == right时,我们找到了一个有效的子串,长度为2 * right,用它来更新最大长度。 - 当

right > left时,说明子串不合法,我们将left和right都重置为 0。 - 从右到左再重复一遍上述过程(这次是当

left > right时重置计数器),以处理像(()这样的情况。 - 时间复杂度: O(N)

- 空间复杂度: O(1)

Two Pointer方法非常巧妙,和22. Generate Parentheses中的使用左右count计数器来判断应该加左括号还是右括号有异曲同工之处。Two Pointer法避免了使用额外的数据结构(如栈或DP数组),将空间复杂度降到了 O(1)。

如何确保哪一次遍历的结果是正确的?我们不需要在两次遍历的“结果”之间做选择。我们维护一个全局的最大长度 max_length,两次遍历都会尝试去更新这同一个变量。 两次遍历是互补的,它们各自负责找到不同类型的有效子串。

- 第一次(从左到右)遍历 :能有效处理像

()(())这样的情况,但会漏掉像(()这样的情况(因为最终left > right,从未触发更新)。 - 第二次(从右到左)遍历 :正好可以弥补第一次的不足,它能有效处理像

(()这样的情况。

所以,两次遍历是一个 合作关系 ,共同协作来找到全局的最优解。

从左到右遍历括号字符串:

当右括号数量多于左括号时:

重置left, right指针

当右括号数量等于左括号时:

记录最大值

重置left,right指针

从右到左遍历括号字符串:

当左括号数量多于右括号时:

重置left,right指针

当左括号数量等于右括号时:

记录最大值

最大值即是最长的合格括号子序列

【括号系列第四题】下一道题:301. Remove Invalid Parentheses

33. Search in Rotated Sorted Array

相比于153,现在不仅要判断是否在哪里卡断,还要判断target的位置。判断逻辑升级为:先判断一个区间(比如左区间)是否是有序的,如果是,那么判断是否在左区间;如果不是,说明右区间是有序的,那么就在右区间里判断是否有target。

...

...

34. Find First and Last Position of Element in Sorted Array

这道题用过两次二分查找,第一次找左边界,第二次找右边界。

从时间复杂度的角度来看,这种“两次二分查找”的解法 就是最优解 。

我们来分析一下为什么。

理论下限 :对于一个排好序的数组,任何基于比较的搜索算法,其时间复杂度的理论最优值就是 O(log n)。你不可能比这个更快,因为每次比较最多只能排除一半的元素。

第一次查找的时间是 O(log n)。第二次查找的时间也是 O(log n)。

总时间 = O(log n) + O(log n) = 2 * O(log n)。大O表示法 :在计算时间复杂度时,我们会忽略常数系数。所以 2 * O(log n) 就等于 O(log n) 。

因此,你的算法达到了理论上的最优时间复杂度。

我们能不能 只用一个 while 循环 来同时找到左右边界呢?

答案是:很难,而且通常不这么做。

原因在于,二分查找的核心是 “抛弃一半” 。当你站在一个 mid 点时:

- 为了找左边界 ,当你找到一个

target时,你需要 向左 收缩区间 (right = mid - 1),去探索左边是否还有更早的target。 - 为了找右边界 ,当你找到一个

target时,你需要 向右 收缩区间 (left = mid + 1),去探索右边是否还有更晚的target。

这两个目标是 相互矛盾 的。在一个 while 循环里,left 和 right 指针的移动方向是唯一的。你不可能让它们既向左收缩又向右收缩。

最接近“一次遍历”的 O(log n) 想法是:

- 用一次二分查找,找到 任意一个

target。 - 然后从这个

target的位置开始,向左和向右 线性地 扩展,直到找到边界。

但这个方法存在一个致命缺陷:在最坏的情况下,比如整个数组所有元素都是 target,那么第2步的线性扩展就会退化成 O(n) 的复杂度,导致整个算法不再是 O(log n)。

...

36. Valid Sudoku

First Meet: Pass with best practice:

class Solution(object):

def isValidSudoku(self, board):

row = {}

column = {}

box = {}

for i in range(9):

for j in range(9):

val = board[i][j] # This can improve a little bit of time efficiency

# skip the '.'

if val == '.':

continue

# for each row, maintain a dict of set

if i not in row:

row[i] = set() # row i's set

if val not in row[i]:

row[i].add(val)

else:

return False

# for each column, maintain a dict of set

if j not in column:

column[j] = set()

if val not in column[j]:

column[j].add(val)

else:

return False

# for each box, maintain a dict of box

box_row = i // 3

box_col = j // 3

if (box_row, box_col) not in box:

box[(box_row, box_col) ] = set()

if val not in box[(box_row, box_col) ]:

box[(box_row, box_col) ].add(val)

else:

return False

return True

...

37. ※ Sudoku Solver (HARD) (MARK)

这道题的关键思路有:

- isValid检查不需要检查整个棋盘,只需要检查新加入的这个数字是否会导致冲突,如果冲突的话就不加

- backtrack的参数直接用整个board,因为这道题只需要解一个board,不需要设置result和path来存储多个结果

参考代码(直观解法):

class Solution(object):

def solveSudoku(self, board):

def is_valid(r, c, ch):

# 检查当前数字 ch 是否可以放在 board[r][c] 处

for i in range(9):

# 检查行和列

if board[r][i] == ch or board[i][c] == ch:

return False

# 检查 3x3 宫格

box_r = 3 * (r // 3) + i // 3

box_c = 3 * (c // 3) + i % 3

if board[box_r][box_c] == ch:

return False

return True

def backtrack():

for r in range(9):

for c in range(9):

if board[r][c] == '.':

for ch in '123456789':

if is_valid(r, c, ch):

board[r][c] = ch

if backtrack():

return True

board[r][c] = '.' # 撤销

return False # 所有数字都试过了,失败

return True # 所有格子都填完了

backtrack()

上述直观解版本是一个非常经典和直观的回溯实现。它的逻辑如下:

solveSudoku(board): 主函数,调用内部的回溯函数backtrack()。backtrack():- 从头到尾(从

board[0][0]到board[8][8])遍历整个数独棋盘。 - 一旦找到一个空格(值为

.),就停下来。 - 尝试将数字 '1' 到 '9' 依次填入这个空格。

- 每填一个数字,就调用

is_valid()函数来检查这个数字在当前位置是否合法(即所在行、列、九宫格没有重复)。 - 如果合法,就继续递归调用

backtrack()来填充下一个空格。 - 如果递归调用成功(返回

True),说明找到了解,立即返回True。 - 如果递归调用失败(返回

False),说明当前数字行不通,需要 撤销选择 (将格子改回.),然后尝试下一个数字。 - 如果 '1' 到 '9' 都尝试失败了,说明此路不通,返回

False。 is_valid(r, c, ch):- 这是一个辅助函数,专门用来检查在

(r, c)位置放入数字ch是否违反数独规则。 - 它会遍历检查 整行 、整列和 整个九宫格 ,看是否存在重复数字。

这个普通解法虽然逻辑清晰,但效率较低,其主要问题在于:

- 大量的重复计算 : 核心瓶颈在于

is_valid()函数。每次我们尝试在一个空格里填入一个数字,都需要重新遍历它所在的行、列和九宫格(总共 9 + 9 + 9 = 27 个单元格)来判断合法性。随着回溯的深入和撤销,这些检查会被反复、大量地执行,造成了巨大的性能浪费。 - 低效的空格查找 :

backtrack()函数每次被调用时,都会从board[0][0]开始遍历,以寻找下一个需要填充的空格。这意味着,在填充棋盘深处的空格时,程序仍然会把前面已经填好的格子重新“看”一遍,这也是一种不必要的重复操作。

针对上面的问题,下面给出一个优化版本。第二个版本针对第一个版本的两个主要痛点进行了精确优化。

- 优化一:用空间换时间,实现 O(1) 的合法性检查

- 做法 : 它没有使用

is_valid()函数,而是创建了三个二维数组rows,cols, 和boxes来记录状态。rows[i][d] = True表示第i行已经存在数字d+1。cols[j][d] = True表示第j列已经存在数字d+1。boxes[b][d] = True表示第b个九宫格已经存在数字d+1。

- 效果 : 在尝试将数字

digit填入(row, col)时,不再需要遍历检查。只需通过if not rows[row][digit] and not cols[col][digit] and not boxes[box_index][digit]这个 O(1) 时间复杂度的查询,就能瞬间判断该数字是否可用。这极大地减少了重复计算,是性能提升的关键。 - 优化二:预处理,避免重复查找空格

- 做法 : 在回溯开始之前,程序会先遍历一次棋盘,将所有需要填充的空格的坐标

(i, j)存入一个列表empty_cells中。 - 效果 : 回溯函数

backtrack(k)直接根据索引k从empty_cells列表中获取第k个要处理的空格。这样,它就跳过了对已填充格子的无效扫描,实现了对空格的 定向、有序访问 ,避免了重复查找。 - 更高效的回溯结构

- 做法 : 回溯函数

backtrack(k)的参数k表示当前正在处理empty_cells列表中的第k个空格。当递归调用backtrack(k + 1)时,它清晰地指向下一个目标,逻辑更加直接。 - 效果 : 这种结构使得回溯路径非常明确,避免了第一个版本中嵌套循环带来的复杂性。

参考代码(竞赛级):

class Solution(object):

def solveSudoku(self, board):

# 优化1:空间换时间,记录每行、每列、每个九宫格已使用的数字

# rows[i][d] = True 表示第 i 行已经有数字 d+1

rows = [[False] * 9 for _ in range(9)]

cols = [[False] * 9 for _ in range(9)]

# boxes[b][d] = True 表示第 b 个九宫格已经有数字 d+1

boxes = [[False] * 9 for _ in range(9)]

# 优化2:预处理,找出所有需要填空的格子

empty_cells = []

# 初始化状态数组和空格列表

for i in range(9):

for j in range(9):

if board[i][j] == '.':

empty_cells.append((i, j))

else:

digit = int(board[i][j]) - 1

box_index = (i // 3) * 3 + (j // 3)

rows[i][digit] = True

cols[j][digit] = True

boxes[box_index][digit] = True

# 定义一个定向回溯函数

def backtrack(k):

# Base Case: 如果所有空格都填完了,说明找到了解

if k == len(empty_cells):

return True

# 获取当前要处理的第 k 个空格的坐标

row, col = empty_cells[k]

box_index = (row // 3) * 3 + (col // 3)

# 尝试填入 '1' 到 '9'

for digit in range(9): # digit from 0 to 8

# 使用 O(1) 检查合法性

if not rows[row][digit] and not cols[col][digit] and not boxes[box_index][digit]:

# 做出选择

board[row][col] = str(digit + 1)

rows[row][digit] = cols[col][digit] = boxes[box_index][digit] = True

# 递归到下一个空格

if backtrack(k + 1):

return True

# 撤销选择 (回溯)

board[row][col] = '.'

rows[row][digit] = cols[col][digit] = boxes[box_index][digit] = False

# 如果 1-9 都无法填入,返回 False

return False

backtrack(0)

...

...

...

...

...

39. ※ Combination Sum

做这道题之前建议先做78 Subsets回溯基础题。

这道题和78相比,增加了一层难度:回溯的时候可以选择自己。

如果单纯只是把backtrack(start_index=i+1)这里的参数从i+1改成i,会导致无限死循环。为了避免这种无限死循环,需要引入一个新的概念:剪枝(pruning)。

Pruning的意思是:如果手里的资源已经用超了,那么就立刻掉头,不用等到走到尽头了。在这道题中,资源就是target。

同时还要注意,计算和的时候不要临时计算,而是把和作为参数去传递。临时计算的话会导致错误。

class Solution(object):

def combinationSum(self, candidates, target):

# a number can be chosen unlimited times

# 可选无限次是和上一道78 Subsets回溯相比的最大区别

# 可选无限次意味着backtrack到下一层后,自己还能再次被选

result = []

cur = []

def backtrack(start_index, cur_sum):

# Pruning一般写在开头(最佳实践)

if cur_sum == target:

result.append(list(cur)) # 这里需要加一个副本 ※※※

if cur_sum > target:

return

for i in range(start_index, len(candidates)):

cur.append(candidates[i])

# 最佳实践的写法:直接在参数传递的时候加上

backtrack(i, cur_sum + candidates[i])

cur.pop()

backtrack(0,0)

return result

...

40. ※ Combination Sum II

做这道题之前推荐先做39。这道题在39的基础上,增加了一个类型的剪枝:对于已经探索过的路径,在绝对重复的情况下,直接跳过。

这个pruning skill建议直接死记硬背地记住,因为这是一个基本功:

在同一层级的递归中,如果当前数字和它钱一个数字相等,那么就要跳过当前数字:

(1)当前元素candidates[i]是否和前一个元素candidates[i-1]相等(因此需要排序)

(2)当前元素不是我们在本轮for循环处理的第一个元素

代码:

if i > start_index and candidates[i-1] == candidates[i]:

continue

以1,1,1,2,3为例,这道题要处理两个重复:

- 组合内重复,一个组合内不能出现1a, 1a, 2这样的重复,这个通过backtrack(i+1)就能解决

- 组合间重复,不能出现1a, 1b, 2和1b, 1c, 2这样的重复,这个比较难想。

第二点如果实在想不出来,暴力的办法就是对结果去重。但是这显然不是我们要学习的方法。这里的思路精髓就是,用 i > start_index来判断,比如说,1b现在是i==1,然后现在start_index==0,这是什么意思呢?这个的意思就是说,现在我们还在刚开始的那一个层面中,只是for循环到了第二层,到了i==1,换句话说,在这一轮次中i==0的1a已经进入过backtrack并完成了回溯工作,这个时候才会轮到i==2的1b作为start_index==0这层的第二轮for循环内容。

也就是说,1a已经搜索过一遍了!并且1a是从头开始搜索的。1a从头开始搜索并且已经搜索完了!

假设我们的target是4,那么已经有1a, 1b, 2这个组合了!这个时候我们就不需要再考虑1b, 1c,2这个组合了!就是说i > start_index防止的是出现类似1a, 1b,2和1b, 1c, 2这样的组合,因此在同样是第一个元素这里当1b发现1a已经完成了回溯工作的时候,1b就不需要重复工作了。

总结来说:为了避免重复,我们规定:在一系列相同的数中,只有排在最前面的那个数,有资格被用于构成新的组合,它后面的“双胞胎”们则全部跳过。

...

42. Trapping Rain Water

Solution1: Dynamic Programming (Easy to Think)

maintain a list max_left:

max_left[i] means the heighest column to the left of column[i]

maintain a list max_right:

max_right[i] means the heighest column to the right of column[i]

calculate each column[i]'s water:

water's volume at column[i] = min(max_left[i], max_right[i]) - height[i]

Time/Space: O(N)

Solution2: Use two pointers, optimize space to O(N)

This idea comes from the formula min(max_left, max_right) - height[i]:

- when max_left is smaller, then the water volume depends on the max_left:

max_left - height[i] - else depends on the right

Therefore:

init pointer i,j

init maxL, maxR as height[0], height[-1]

while i <= j: # The boundry here is very important

if maxL <= maxR:

calculate maxL - height[i]

note: if height[i] >= maxL, then don't calculate, update maxL

else:

calculate maxR - height[j]

note: if height[j] >= maxR, then don't calculate, update maxR

Time: O(N)

Space: O(1)

...

43. Multiply Strings

...

45. ※ Jump Game II

set a cur_range

set a max_range

use greedy strategy:

when i not reach cur_range:

max(max_range, cur_max_range)

这道题思路简单但是写代码老写错:

class Solution(object):

def jump(self, nums):

cur_range = 0

max_range = 0

count = 0

for i in range(len(nums)-1):

max_range = max(nums[i]+i, max_range)

if i == cur_range:

cur_range = max_range

count += 1

return count

...

46. Permutations

78 Subset中首见回溯Backtracking问题的时候已经给出了解法。

重要提醒:

- path如果是list,加入result的时候一定要记得转换为list

- 无论进行了什么附加操作,都不要忘记backtrack之后的回溯步骤!

这道题的特别优化:用used[i](存储True/False)比用set存储用过的数字更加高效

47. Permutations II

和46的区别在于47的list中包含重复元素,因此有什么区别?不都可以用一个used list(带有index指针的)来pruning?

区别在于,如果有重复的列表,的确生成的结果是独一无二的,但是很多独一无二的结果是一样的结果,比如1,1,2,我们记作1a, 1b,2,其结果:

- 1a, 1b, 2

- 1b, 1a, 2

都是[1,1,2],在出结果的时候只出一个[1, 1, 2]

这里的关键点就在于pruning:

- 规则:(必须先排序)如果发现当前的数和左邻居一样,并且左邻居还没用过,那么我们就必须跳过当前这个数字。

为什么有这个规则呢?因为为了防止重复记录,我们必须遵从以下规则:

- 排序数组后,必须从左往右而不能跳过任何元素

即,对于一堆相同的数字,必须严格从左到右按照顺序挑选。如果左邻居使用过,那么我们就符合从左到右规则,就可以继续使用当前的数字。

48. Rotate Image

注意:这个题的要求是原地修改,一般要求原地修改的,不能增加额外的空间开销。所以用旋转遍历然后旋转放置的方法是不可以的。

初见用旋转遍历和旋转遍历放置通过,但是空间复杂度很高。旋转遍历并用deque存储matrix信息的方法:

- 时间复杂度:O(2N^2)

- 空间复杂度:O(N^2)

方法二:Transpose&Reverse(符合题目要求)

- 时间复杂度:O(N^2)

- 空间复杂度:O(1)

class Solution(object):

def rotate(self, matrix):

n = len(matrix)

# 1. Transpose 转置矩阵

for i in range(n):

# 注意这里是 (i,n),这样做的目的是放置重复交换

for j in range(i, n): # 注意这里是(i,n)

# 交换 matrix[i][j] 和 matrix[j][i]

matrix[i][j], matrix[j][i] = matrix[j][i], matrix[i][j]

# 2. Reverse 翻转每一行

for i in range(n):

matrix[i].reverse()

这道题本质上是想练习transpose转置,这是一个非常重要的数学操作。Transpose就是把行变成列,把列变成行。

上面的显然只适合NxN的matrix,如果是MxN的matrix,需要用下列方法:

def transpose_matrix(matrix):

# 对一个 M x N 的矩阵进行转置操作。

# :param matrix: 一个 M x N 的列表的列表 (List[List[int]])

# :return: 一个 N x M 的新的转置后的矩阵

# 处理空矩阵或无效输入的边缘情况

if not matrix or not matrix[0]:

return []

# 1. 获取原始矩阵的维度

M = len(matrix) # 原始行数

N = len(matrix[0]) # 原始列数

# 2. 创建一个新的 N x M 的矩阵,并用 0 或 None 初始化

# 新矩阵有 N 行 M 列

transposed = [[0 for _ in range(M)] for _ in range(N)]

# 3. 遍历原始矩阵,填充新矩阵

for i in range(M):

for j in range(N):

# 将原始矩阵的 (i, j) 元素放到新矩阵的 (j, i) 位置

transposed[j][i] = matrix[i][j]

return transposed

# --- 使用示例 ---

# 一个 2x3 的矩阵

matrix_A = [

[1, 2, 3],

[4, 5, 6]

]

# 调用函数进行转置

transposed_A = transpose_matrix(matrix_A)

# 打印结果,应该是一个 3x2 的矩阵

# [[1, 4],

# [2, 5],

# [3, 6]]

for row in transposed_A:

print(row)

...

49. Group Anagrams

hashmap基础题,没什么难点。

50. Pow(x,n)

Fast Exponentiation:

class Solution:

def myPow(self, x: float, n: int) -> float:

# 边界情况:n = 0,任何数的 0 次方都是 1

if n == 0:

return 1.0

# 边界情况:n < 0,转换为 1 / myPow(x, -n)

if n < 0:

return 1.0 / self.myPow(x, -n)

# --- 快速幂核心逻辑 ---

# 递归地计算 myPow(x, n/2)

# n // 2 确保了 n 会不断变小,最终达到 n=0 或 n=1 的基本情况

half = self.myPow(x, n // 2)

# 如果 n 是偶数, myPow(x, n) = myPow(x, n/2) * myPow(x, n/2)

if n % 2 == 0:

return half * half

# 如果 n 是奇数, myPow(x, n) = myPow(x, n/2) * myPow(x, n/2) * x

else:

return half * half * x

No.51 - No.100

51. N-Queens

初见代码及修改版:

class Solution(object):

def solveNQueens(self, n):

"""

:type n: int

:rtype: List[List[str]]

"""

# --- 错误部分已注释 ---

# 这个方向数组有错误(重复了[-1,-1]),并且用它来检查对角线效率不高且复杂。

# 在N皇后问题中,我们通常按行放置,所以只需要检查当前行之前的皇后位置即可。

# directions = [

# [-1,-1],

# [1,-1],

# [-1,1],

# [1,1]

# ]

# 正确的二维列表初始化 (您的修改是正确的,予以保留)

grid = [['.' for _ in range(n)] for _ in range(n)]

# 最终结果列表,我们将直接把符合格式的棋盘存入这里

result = []

# --- 修改 isValid 函数 ---

# 原来的isValid函数逻辑上没问题,但可以优化。

# 因为我们是按行从上往下放皇后,所以在检查 (row, col) 时,

# 我们根本不需要检查当前行 (row) 或之后的行,因为那些行还没有皇后。

# 我们只需要检查之前的行 (0 到 row-1) 即可。

def isValid(row, col):

# 检查同一列是否有Q (只需检查当前列上方的行)

for i in range(row):

if grid[i][col] == 'Q':

return False

# 检查左上对角线

r, c = row - 1, col - 1

while r >= 0 and c >= 0:

if grid[r][c] == 'Q':

return False

r -= 1

c -= 1

# 检查右上对角线

r, c = row - 1, col + 1

while r >= 0 and c < n:

if grid[r][c] == 'Q':

return False

r -= 1

c += 1

return True

# --- 错误部分已注释 ---

# N皇后问题的核心是“每行有且仅有一个皇后”。

# 原来的回溯函数 `backtrack(start_i, start_j)` 试图在整个棋盘上找N个点,

# 这个逻辑不符合N皇后的约束,而且非常低效。

# 此外,原来的代码没有在 grid 上做状态的修改和撤销(“做选择”和“撤销选择”)。

# result = []

# path = []

# def backtrack(start_i, start_j):

# if len(path) == n:

# result.append(list(path))

# return

#

# for i in range(start_i, n):

# for j in range(start_j, n):

# # 尝试在此处下一子

# if isValid(i, j):

# # 如果此处可以下子

# path.append((i,j))

# for direction in directions:

# dx, dy = direction

# new_row, new_col = i + dx, j + dy

# backtrack(new_row, new_col)

# path.pop()

# --- 新增/修改:正确的回溯函数 ---

# 我们定义回溯函数 backtrack(row),它的任务是在第 `row` 行找到一个合法的位置放皇后。

def backtrack(row):

# 递归的终止条件:如果成功放到了第 n 行 (row 从0开始),

# 说明我们已经找到了一个完整的解。

if row == n:

# 将当前的 grid 棋盘状态转换为题目要求的 List[str] 格式

temp_board = []

for r in grid:

temp_board.append("".join(r))

# 将这个解加入最终结果

result.append(temp_board)

return

# 遍历当前行的每一列,尝试放置皇后

for col in range(n):

# 检查在 (row, col) 这个位置放皇后是否合法

if isValid(row, col):

# 1. 做选择:在这个位置放一个皇后

grid[row][col] = 'Q'

# 2. 进入下一行,继续递归

backtrack(row + 1)

# 3. 撤销选择:将这个位置恢复原状,以便在当前行的下一列进行尝试

# 这步是回溯算法的关键

grid[row][col] = '.'

# --- 修改:从第0行开始调用回溯函数 ---

backtrack(0)

# --- 错误部分已注释 ---

# 下面这一大段后处理逻辑不再需要了。

# 因为我们已经在回溯函数的终止条件里,直接生成了符合格式的解,

# 并添加到了 `result` 列表中。

# output = []

# for ls in result:

# # ls中记录了N个tuple

# board = [['.' for _ in range(n)] for _ in range(n)]

# # 设置一个board,记录所有的Q

# for t in ls:

# # 每个t都对应着Q的位置

# qx, qy = t

# board[qx][qy] = 'Q'

# # 现在把board的每一行转换为一个string

# new_ls = []

# for board_row in board:

# new_row = ''.join(board_row)

# new_ls.append(new_row)

# # 现在new_ls就是符合要求的一个结果

# output.append(new_ls)

# --- 修改:直接返回 result ---

# result 列表现在已经包含了所有符合格式的解

return result

...

...

53. Maximum Subarray

Kadane's algorithm.

54. Spiral Matrix

这道题主要用来练习对Matrix的操作和coding时对边界的处理。

在python中,首先创建matrix需要一次性创建,比如:matrix = [[element for _ in range(...)] for _ in range(...)]。

这道题思路不难,但是coding的时候有很多细节需要注意,建议把这道题的coding内容着重复习,熟悉matrix的边界。

class Solution(object):

def spiralOrder(self, matrix):

# 处理空矩阵的边界情况

if not matrix or not matrix[0]:

return []

rows, cols = len(matrix), len(matrix[0])

output = []

# 定义四个边界

left, right, top, bottom = 0, cols - 1, 0, rows - 1

# 循环条件:确保边界内部至少还有一层元素

# 这里要注意,等于代表还有一行,top > bottom的时候才是矩形框内没有元素了

# 这里要注意,一定要用and,为什么呢?因为如果遍历完所有的行后,top会大于bottom,这个时候程序中left<=right可能还是成立的

while left <= right and top <= bottom:

# 1. 从左到右遍历上边界 (top)

# 范围是从左边界(left)到右边界(right)

for c in range(left, right + 1):

output.append(matrix[top][c])

# 上边界向下收缩

top += 1

# 2. 从上到下遍历右边界 (right)

# 范围是从新的上边界(top)到下边界(bottom)

for r in range(top, bottom + 1):

output.append(matrix[r][right])

# 右边界向左收缩

right -= 1

# 在收缩后,必须检查边界是否仍然有效,以防只有一行或一列的情况

# 这里要注意:相等的时候代表上下重合,即只有一行

if not (left <= right and top <= bottom):

break

# 3. 从右到左遍历下边界 (bottom)

# 范围是从新的右边界(right)反向到左边界(left)

for c in range(right, left - 1, -1):

output.append(matrix[bottom][c])

# 下边界向上收缩

bottom -= 1

# 4. 从下到上遍历左边界 (left)

# 范围是从新的下边界(bottom)反向到上边界(top)

for r in range(bottom, top - 1, -1):

output.append(matrix[r][left])

# 左边界向右收缩

left += 1

return output

55. Jump Game

记得先判断当下位置是不是在可达范围内

...

...

...

...

...

...

56. Merge Intervals

这种题目中没有说sort的题目一定要sort一下。

57. ※ Insert Interval

这道题是56基础上增加了一个newInterval,变得很有意思,因为newInterval的存在可能会改变原本的interval,所以如果直接遍历的话既需要考虑newInterval,也需要考虑原本的interval list。一来一回这个方法最终会变得无比复杂,因此用56的merge方法是不可行的。

这道题最佳实践是分而治之,将问题分为三个清晰、独立的阶段。

核心思想:三段论 (The Three-Phase Approach)

想象一下你正在处理一条传送带上的物品(即 intervals 列表),而你手里有一个新物品(newInterval)。你的任务是把新物品放到传送带的正确位置,并和它接触到的物品合并。

整个过程可以清晰地分为三步:

-

左侧部分(无重叠) :传送带上有些物品在你的新物品应该在的位置的 左边 ,并且完全碰不到它。对于这些物品,你什么都不用做,直接把它们按原样放到新的传送带(

result列表)上。 -

判断条件 :

当前区间[1] < newInterval[0](当前区间的结束位置,在新区间的开始位置之前)。 -

中间部分(合并) :接下来,你会遇到一串和你的新物品有重叠的物品。你需要把所有这些重叠的物品和你手里的新物品融合成一个更大的物品。

-

操作 :不断更新你手里

newInterval的边界,让它“吞下”每一个重叠的区间。newInterval的新起点是它自己和当前区间起点的较小值,新终点是它自己和当前区间终点的较大值。 - 判断条件 :

当前区间[0] <= newInterval[1](当前区间的开始位置,不晚于新区间的结束位置)。只要满足这个条件,就说明有重叠。 -

右侧部分(无重叠) :处理完所有重叠的物品后,你手里现在有了一个最终合并好的、更大的新物品。首先,把它放到新的传送带上。然后,传送带上剩下的所有物品肯定都在它的 右边 ,并且不会和它重叠。你只需把这些剩下的物品原样依次放到新的传送带上即可。

-

操作 :将合并后的

newInterval添加到result,然后将intervals中所有剩余的区间直接添加到result。

这种方法的优势在于:

- 逻辑清晰 :每一步只做一件事,没有复杂的嵌套判断。

- 高效 :只需要遍历一次

intervals列表,时间复杂度为 O(N)。 - 健壮 :可以优雅地处理所有边界情况(例如,

intervals为空、newInterval在最前或最后)。

result = []

i = 0

n = len(intervals)

# 注意:这里千万不要随便设置变量记录newIntervals

# 因为newIntervals本身也被作为变量使用

# 第一段:添加在newInterval左边且无交集的区间

while i < n and intervals[i][1] < newInterval[0]:

result.append(intervals[i])

i += 1

# 第二段:合并所有与newInterval重叠的区间

# 因为第一段的内容已经排除了,所以这里只需要判断当下区间开始段是否还在newInterval范围内

while i < n and intervals[i][0] <= newInterval[1]:

newInterval[0] = min(newInterval[0], intervals[i][0])

newInterval[1] = max(newInterval[1], intervals[i][1])

i += 1

result. append(newInterval)

# 第三段:剩下的都是在newInterval右侧且无交集的,只需要直接加

while i < n:

result.append(intervals[i])

i += 1

return result

...

...

...

58. Length of Last Word

太简单了,没什么说的。倒着traverse,从第一个字母开始,到最后一个字母结束。用 .isalpha()来判断是否是字母。

不过有个一行解法很有意思:return len(s.strip().split(' ')[-1]),但是因为要处理整个list,反而增加了时间复杂度和空间复杂度,属于没有什么意义的写法,但是作为趣味可供一乐。

...

62. Unique Paths

2d dp入门题目。

63. Unique Paths II

2d dp入门题目。

...

66. Plus One

...

假设我们加的数字是K(K是个位数):

if k == 0:

return digits

carry = k

for i in range(len(digits)-1,-1,-1):

if carry == 0:

return digits

cur_sum = digits[i] + carry

digits[i] = cur_sum % 10

carry = cur_sum // 10

if carry > 0:

digits.insert(0,carry)

return digits

...

68. Text Justification

这道题直观思路简单,直接greedy一行一行往上填,难点是把代码coding出来(写了几次总是这儿那儿漏点东西),特别是分配带有多个可能不相等的空格的行的时候。

...

70. Climbing Stairs

1D DP教学题,尝试用两种方法来解决。

71. Simplify Path

这道题初见可以学习一下字符串处理中的几个常见用法:find, replace, split, join。用这几个用法可以轻松解决本题,初见答案如下:

while path.find("//") > -1:

path = path.replace("//", "/")

if path[-1] == "/":

path = path[:-1]

ls = path.split("/")

queue = deque(ls)

queue.popleft()

output = []

while queue:

cur_element = queue.popleft()

if cur_element == ".." and not output:

continue

elif cur_element == ".." and output:

output.pop()

continue

elif cur_element == ".":

continue

else:

output.append(cur_element)

if not output:

return "/"

string = '/' + '/'.join(output)

return string

时间复杂度O(N),空间复杂度O(N)。

当然,时间复杂度这里明显在第一个while循环这里稍微有点不够优雅,这里怎么优化呢?

其实,不需要预处理字符,直接split,这个时候会发生什么呢?那些多余的/都会被处理为空字符!

最佳实践:

ls = path.split("/")

result = []

for element in ls:

if element == "" or element == ".":

continue

elif element == "..":

if result:

result.pop()

else:

result.append(element)

return "/" + "/".join(result)

...

73. Set Matrix Zeroes

这道题思路很简单,但是要注意优化。

最佳实践(空间复杂度为O(1)):

- 先检查第一行和第一列是否有零,记录在两个变量中

- 然后遍历其他行列,遇到零就在对应的第一行和第一列做标记

- 重新遍历matrix,根据标记设置0

- 最后根据一开始的两个变量,决定是否把第一行和第一列转0

...

74. ※ Search a 2D Matrix

【教学题:二维矩阵的降维搜索】

这道题的核心要求是以 O(log(m∗n)) 的时间复杂度在一个特殊的二维矩阵中查找目标值。这个时间复杂度是一个非常强的提示,它几乎总是指向 二分搜索 (Binary Search) 算法。一个常规的思路是遍历矩阵,但时间复杂度为 O(m∗n),不符合要求。另一个思路是逐行进行二分搜索,时间复杂度为 O(m∗logn),同样不达标。

要达到 O(log(m∗n)),我们需要将整个矩阵看作一个整体进行二分搜索。题目的两个属性是解题的关键:

- 每行内部递增 :

matrix[i][j] < matrix[i][j+1] - 下一行的开头大于上一行的结尾 :

matrix[i+1][0] > matrix[i][n-1]

这两个属性结合起来,意味着如果我们把这个二维矩阵 “铺平” (flatten),从第一行到最后一行依次连接起来,就会得到一个 完全有序的一维数组 。

例如,矩阵 [[1,3,5,7], [10,11,16,20], [23,30,34,60]] 可以看作是虚拟的一维数组 [1, 3, 5, 7, 10, 11, 16, 20, 23, 30, 34, 60]。既然可以看作一个有序的一维数组,我们就可以直接在这个虚拟数组上进行二分搜索。这个虚拟数组的长度为 m * n,索引范围是 0 到 m * n - 1。

接下来的问题是:如何在二分搜索中,将一维的索引 mid 转换回二维矩阵的坐标 (row, col)?

假设矩阵有 m 行 n 列。对于一个一维索引 idx:

- 它对应的行号是:row=⌊idx//n⌋ (整除)

- 它对应的列号是:col=idx%n (取余)

举例: 在一个 3x4 的矩阵中,一维索引 7 对应的值是什么?

row = 7 / 4 = 1col = 7 % 4 = 3- 所以它对应的是

matrix[1][3]。

算法步骤:

- 初始化指针 :设

left = 0,right = m * n - 1。这代表了我们虚拟一维数组的搜索范围。 -

循环搜索 :当

left <= right时,执行循环: a. 计算中间索引:mid = left + (right - left) / 2。 b. 将mid转换为二维坐标:row = mid / n,col = mid % n。 c. 获取中间值:mid_val = matrix[row][col]。 d. 比较 : -

如果

mid_val == target,恭喜你找到了,返回true。 - 如果

mid_val < target,说明目标值在右半部分,更新left = mid + 1。 - 如果

mid_val > target,说明目标值在左半部分,更新right = mid - 1。 - 未找到 :如果循环结束仍未找到,说明目标值不存在,返回

false。

通过这种方式,我们只进行了一次二分搜索,其搜索空间是 m * n,因此时间复杂度完美地符合 O(log(m∗n))的要求。

这种将多维结构映射到一维有序结构并利用二分搜索进行高效查找的思想,在计算机科学的许多领域都有广泛应用。

- 数据库索引 (Database Indexing)

- 数据库中的复合索引(Composite Index)与此非常相似。比如,一个索引基于

(姓氏, 名字)两列排序,数据库在查找时可以高效地定位到特定姓氏的范围,再在该范围内查找名字,其原理与在此矩阵中先定位行再定位列的另一种解法(两次二分搜索,复杂度为 O(logm+logn))异曲同工。 - 内存管理 (Memory Management)

- 操作系统在管理内存时,可能会将空闲的内存块按照地址或大小组织成一个有序列表。当需要分配一块特定大小的内存时,就可以使用二分搜索来快速找到一个合适的空闲块。

- 地理信息系统 (GIS) 与空间数据

- 在处理地理空间数据时,为了加速区域查询(例如,查找某个矩形区域内的所有点),常常使用一种叫做“空间填充曲线”(Space-filling Curve)的技术,如 Z-order curve 或 Hilbert curve。这种技术能将二维或三维空间点映射到一维线上,同时尽量保持其空间的局部性。之后,就可以在一维表示上使用类似二分搜索的快速查找算法。

- 数据压缩与编码

- 在某些编码方案中,符号表或字典是按特定顺序组织的。解码或查找某个编码对应的原始数据时,如果字典有序,就可以通过二分搜索来加速查找过程。

总而言之,这个算法的核心价值在于展示了一种降维思想 :当一个多维数据结构因其内在的排序属性而可以被视为一个“隐式”的一维有序数组时,我们就可以应用最高效的一维搜索算法(二分搜索)来解决问题,从而避免了代价高昂的多维遍历。

75. Sort Colors

这道题有两种解法:

- Counting Sort

- 直接一次遍历

一次遍历最巧妙:

- 这个方法使用三个指针

low,mid,high将数组分为三部分: [0, low-1]:全部是 0[low, mid-1]:全部是 1[high+1, n-1]:全部是 2mid指针负责遍历数组,根据nums[mid]的值与low或high指针指向的元素进行交换。

一次遍历法的代码如下:

low = 0

mid = 0

high = len(nums) - 1

while mid <= high:

if nums[mid] == 0:

nums[low], nums[mid] = nums[mid], nums[low]

low += 1

mid += 1

elif nums[mid] == 1:

mid += 1

else:

nums[mid], nums[high] = nums[high], nums[mid]

high -= 1

...

76. ※ Minimum Window Substring (Hard)

最小覆盖子串。这道题的match_count的用法非常巧妙,值得记忆。

这里要注意,我第一遍做的时候逻辑是严格包含word中的字符数量,这样会导致错误。正确思路应该是,当子串中包含word中的字符的时候,无论是不是多包含了,都应该被视为包含。比如说,'ggggggggggggggood'这个string,如果要找good,那么用滑动窗口的时候,很明显在'ggggggggggood'的时候才找到了对应的字串,这个时候有非常多个g,需要慢慢收缩左指针left,进而找到最短的子串。

我在第一次写的时候用两个hashmap比对,会导致每次比对的时候牺牲O(M)的时间,其中M是字符t中不同字符的数量,即最坏的情况下是len(t)。right指针循环一遍是O(N),因此最坏情况是O(M*N)。

正确思路以及本题最核心的要点是维护一个match_count变量,这个变量将记录符合要求的字符数量,当且仅当在刚好符合或者刚好从符合变得不符合的时候调整这个变量,这也是sliding window中非常常见的一种思路。

时间复杂度通过常量match_count的设置可以降低到O(M+N)。

算法思路:

设置一个origin hashmap,存放目标字符统计

设置一个window hashmap,存放window内的字符统计

设置一个match_count,巧妙快捷地记录符合要求数

left = 0

for right in range(len(s)):

当下正在遍历访问的字符是cur_char

把cur_char加入到window中(扩大window)

更新匹配数,※当且仅当window中的cur_char==origin中的时才更新

当match_count == len(origin)的时候,循环:

只要能进入这个循环,就说明当前的window是有效的

所以,第一步就是更新结果,即判断是否要更新最小字符串

然后,第二部是收缩:

收缩的时候判断减少的left字符是否影响了match_count

更新window hashmap

最后,移动左指针

return 最小字符串

最佳实践:

class Solution(object):

def minWindow(self, s, t):

if not s or not t:

return ""

left = 0

match_count = 0

# hashmap for t {alphabet: frequency}

origin = {}

for char in t:

origin[char] = origin.get(char, 0) + 1

left = 0

window = {}

min_len = float('inf')

min_string = ''

for right in range(len(s)):

cur_char = s[right]

window[cur_char] = window.get(cur_char, 0) + 1

# 用是否严格相等来判断是否调整match_count

if cur_char in origin and window[cur_char] == origin[cur_char]:

match_count += 1

# 整个的这个while循环是本题最难写的一个部分

# while循环内不同环节的顺序很巧妙

# 下面给出的是最佳实践顺序

while match_count == len(origin):

# 首先更新最小字符串

cur_string = s[left:right+1]

cur_len = len(cur_string)

if cur_len < min_len:

min_string = cur_string

min_len = cur_len

# 然后收缩,这里要注意,收缩的时候也是用==去判断

left_char = s[left]

if left_char in origin and window[left_char] == origin[left_char]:

match_count -= 1

# 收缩判断后再更新windows hashmap,可以防止出错

window[left_char] -= 1

# 最后再移动左指针

left += 1

if min_len == float('inf'):

return ""

return min_string

...

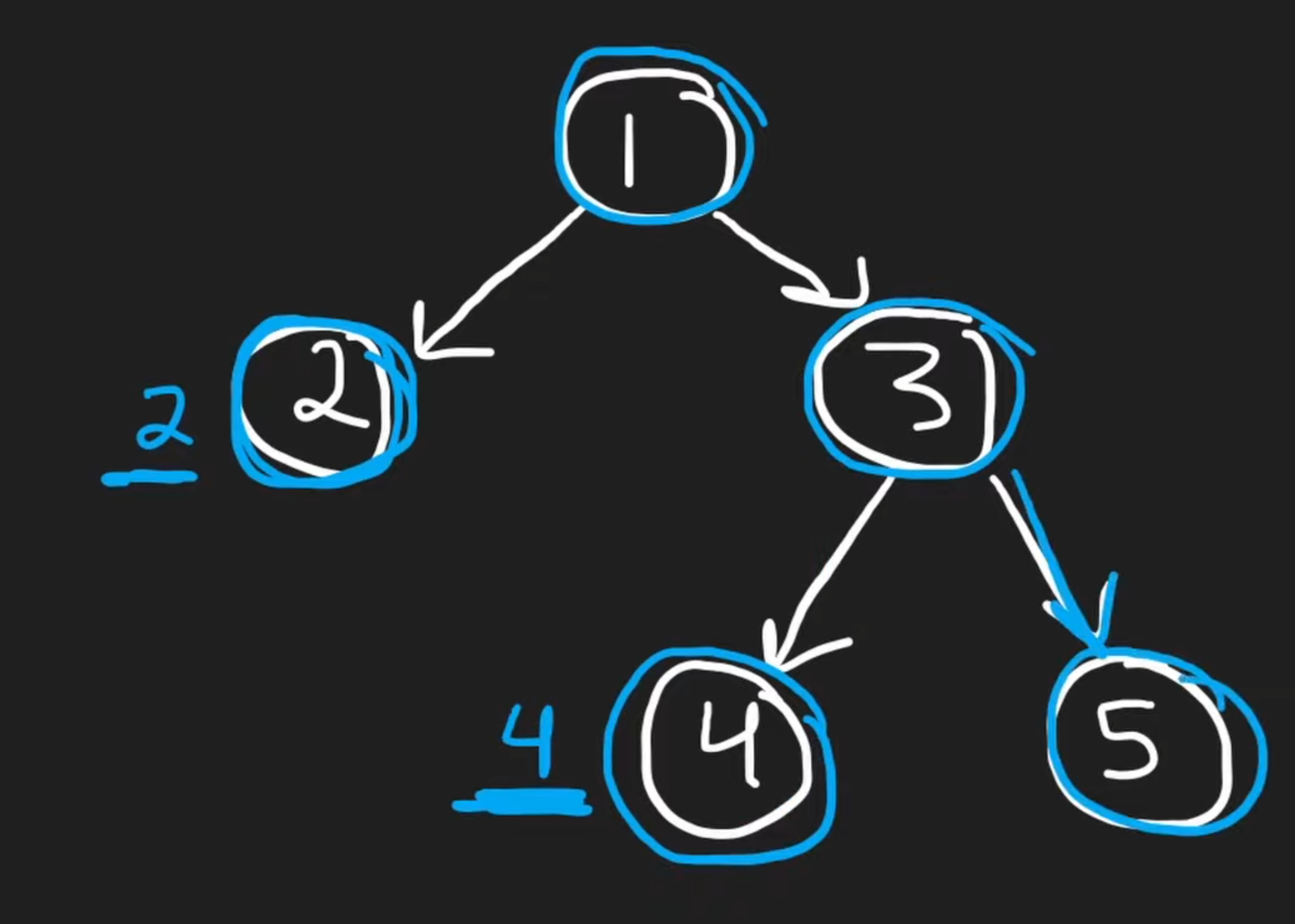

78. ※ Subsets

Backtracking回溯算法入门题。

借这道题来讲一下回溯算法的概念和基本思想。【关键词:回溯教程/Backtracking教程/Backtracking Tutorials】

Backtracking可以被看作是一种聪明的暴力枚举法,他会尝试所有可能的选择;当发现当前的路走不通或者走完的时候,他会回溯,也就是退到上一步,尝试其他的选择。

这就像你在走一个迷宫:

- 你在一个路口,面前有几条路( Choose 选择 )。

- 你选择一条路往前走( Explore/Forward 递进 )。

- 如果这条路是死胡同,或者你已经走到了迷宫的尽头,你就需要原路返回到上一个路口(Backtrack 回溯 ),然后尝试你没走过的其他路。

对于这道题,我们的算法流程是这样的:

- 开始 :从一个空子集

[]开始。 -

决策 :对于

nums数组中的第一个数字(比如1),我们做选择: -

不选

1:继续考虑下一个数字2。 -

选

1:把1加入当前子集,变成[1],然后继续考虑下一个数字2。 -

递进 :对每一个后续数字都重复这个“选”与“不选”的决策过程。

- 结束与回溯 :当我们考虑完

nums里的所有数字后,就得到了一个完整的子集,把它加入最终结果列表。然后,算法会“回溯”到上一个决策点,去探索其他的选择分支。

举例 nums = [1, 2, 3]:

- 从

[]开始。 - 考虑

1: - 不选

1-> 接着考虑2。 - 不选

2-> 接着考虑3。- 不选

3-> 得到子集[]。 - 选

3-> 得到子集[3]。

- 不选

- 选

2-> 接着考虑3。- 不选

3-> 得到子集[2]。 - 选

3-> 得到子集[2, 3]。

- 不选

- 选

1-> 接着考虑2。 - 不选

2-> 接着考虑3。- 不选

3-> 得到子集[1]。 - 选

3-> 得到子集[1, 3]。

- 不选

- 选

2-> 接着考虑3。- 不选

3-> 得到子集[1, 2]。 - 选

3-> 得到子集[1, 2, 3]。

- 不选

你看,通过这种系统性的决策和回溯,我们就能不重不漏地找出所有 2^n(n 是元素个数)个子集。

那么如何在计算机上实现回溯呢?下面举一个最简单的例子:

我们就用一个比求子集更简单的例子来彻底搞懂回溯的三个步骤: 生成所有长度为 2 的二进制字符串 。

我们的目标是生成:00, 01, 10, 11。

在这个问题里:

- 元素集合 :

['0', '1'] - 决策 :在字符串的每一个位置,我们都要决定是放 '0' 还是 '1'。

- 目标 :构建一个长度为 2 的字符串。

一个标准的回溯函数,通常包含下面三个部分:

- 函数的参数 :需要记录当前的状态。这里我们需要知道“当前正在构建的路径(path)”和“接下来要做的决策(决策列表)”。

- 递归的出口(Base Case) :什么时候算找到一个完整的解了?对于本例,就是当我们的路径长度达到 2 的时候。这时我们就把路径保存下来,然后返回。

- 循环和递归调用 :遍历当前所有可做的选择,做出选择,然后带着这个选择进入下一层决策。决策完成后,一定要撤销刚才的选择,这样才能去尝试其他的选择。

用python来实现这个过程:

def generate_binary_strings(n):

"""

主函数,用来启动整个回溯过程

"""

# result 用来存放所有找到的解

result = []

# path 用来记录当前正在走的路径(即正在构建的字符串)

path = []

def backtrack():

# --- 2. 递归的出口 (Base Case) ---

# 如果当前路径的长度已经达到 n,说明我们找到了一个完整的解

if len(path) == n:

# 将路径拼接成字符串,加入最终结果

result.append("".join(path))

# 找到一个解了,结束当前这条路的探索,返回

return

# --- 3. 循环和递归调用 ---

# 对于当前位置,我们有哪些选择?就是 '0' 和 '1'

possible_choices = ['0', '1']

for choice in possible_choices:

# 1. 选择 (Choose)

# 做出选择,把 '0' 或者 '1' 加入到当前路径中

path.append(choice)

# 2. 递进 (Explore)

# 进入下一层决策。因为path已经变长了,

# 下一层的函数调用会去决定下一个位置的字符。

backtrack()

# 3. 回溯 (Backtrack)

# **这是最关键的一步!**

# 当上一行 backtrack() 函数返回时,

# 说明基于当前 choice 的所有后续路径都探索完了。

# 我们必须撤销刚才的选择(把加进去的字符删掉),

# 这样 for 循环下一次迭代时,才能去尝试其他的选择。

path.pop()

# 从这里开始第一次调用,启动整个过程

backtrack()

return result

# 让我们来运行一下,生成长度为 2 的所有二进制字符串

final_result = generate_binary_strings(2)

print(final_result)

第一次接触backtracking的时候,最难理解的就是3. 回溯的部分。这里其实是利用了程序运行时function call的原理,即当backtrack()被调用后,这个时候程序在这里相当于暂停了,然后启动了一个新的子任务;当子任务结束后,程序就会回到这里来继续。

这背后是程序运行的一个基本概念: 函数调用栈 (Function Call Stack) 。

你可以把函数调用想象成一个“暂停/继续”的游戏:

- 当你调用一个函数时,比如

A调用B,那么函数A就会在调用的地方 暂停 ,等待B的结果。 - 函数

B开始执行。如果B又调用了C,那么B也会在那个地方 暂停 ,等待C的结果。 - 当

C执行完毕return时,它会把结果(或什么都不给)返回给B。然后,函数B就会从它刚才暂停的地方 继续往下执行 。 - 同理,当

B执行完毕return时,A也会从它暂停的地方 继续往下执行 。

所以过程实际上如下:

- backtrack()

- path.append(0)

- backtrack()

- path.append(0)

- backtrack()

- base case

- return

- pop

- path.append(1)

- backtrack()

- base case

- return

- pop

- pop

- path.append(1)

- backtrack()

- path.append(0)

- backtrack()

- basecase

- return

- pop

- path.append(1)

- backtrack()

- base case

- return

- pop

- pop

- the function call end

可见,回溯表面上看起来是走回去,其实本质上还是在往下走,在这个过程中利用程序的暂停机制实现了看起来走过去又走回来的特性。真的是太美妙了!

现在回到这道题来,这道题和上面的不同之处在于:

- 选择列表是有限制的,不能每一次都在备选中随便选;一旦被选过,就不能再被选;只能从前往后选。

要实现上述功能,需要用到一个子集/组合问题回溯算法的标志性技巧:

- 给backtrack函数增加一个参数start_index,告诉他这次for循环应该从nums的哪个位置开始

class Solution(object):

def subsets(self, nums):

# 正确的回溯不会产生重复的情况,所以这里直接用list存储result

result = []

path = []

def backtrack(start_index):

result.append(list(path))

# 这里不需要这个base case

# 在本题中,只要不进入for循环,就算是结束了

# if len(path) == len(nums):

# return

# start_index = len(path)

# 不适用参数传递的方法会导致后续紊乱

for i in range(start_index, len(nums)):

path.append(nums[i])

# 这里很关键,第一次写成start_index了

# 但是这里如果写成start_index

# 第一轮将正常进行

# 但是第二轮将错误进行,因为1,2,3来看的话

# 1完了2,2完了3,但是2和3的轮次完了后

# 应该直接跟3,因为[2,3]和[3]在本题中是并列的可选子集

backtrack(i+1)

path.pop()

backtrack(0)

return result

通过这道题,对回溯的思想进行了一个系统性的讲解。

...

79. ※ Word Search

这是一道DFS+Backtracking的经典题目,建议牢记解法。

用DFS验证点是否匹配word[i]:

如果找到,return True

如果已经在路径中 或者 越界 或者 字符不匹配, return False

path.add((r,c))

向四个方向探索 ※ 如果为True,说明找到了

path.remove((r,c))

遍历grid:

if DFS(点,0):

return True

return False

这道题的代码一定要熟悉,是一种模板:

class Solution(object):

def exist(self, board, word):

rows = len(board)

cols = len(board[0])

path = set() # 路径集合,用于防止重复访问

def dfs(r, c, i):

# 1. 递归成功的终止条件:i 越过了单词的最后一个字符,说明全部找到了

if i == len(word):

return True

# 2. 递归失败的终止条件(把所有错误情况一次性处理)

if (r < 0 or c < 0 or # a. 越界检查

r >= rows or c >= cols or

board[r][c] != word[i] or # b. 字符不匹配检查 (你的代码缺失了这个!)

(r, c) in path): # c. 当前坐标是否已在路径中 (你的代码写错了!)

return False

# --- 到这里说明 (r, c) 这个点是有效的 ---

# 3. 做出选择 (将当前点加入路径)

path.add((r, c))

# 4. 向四个方向进行下一层递归

# 只要有一个方向成功 (返回True),就立即停止并返回 True

# (这解决了你代码中 "found" 被覆盖的问题)

for dr, dc in directions:

if dfs(r+dr, c+dc, i+1):

found = True

break # 一旦找到,就没必要继续尝试其他方向了, 跳出循环

# 5. 撤销选择 (回溯,为其他路径的探索让路)

path.remove((r, c))

return found

# 主循环

for r in range(rows):

for c in range(cols):

# 只需要在这里调用一次 dfs,所有逻辑都在 dfs 内部

# 我们从 (r,c) 开始,尝试匹配 word 的第一个字符 (i=0)

if dfs(r, c, 0):

return True

return False

...

80. ※ Remove Duplicates from Sorted Array II

题目要求是不超过2次重复,按照造轮子的指导方针,这道题现在应当直接给出一个通用解了。

设计一个通用解,关键在于写入条件:一个元素应当被保留,当且仅当:

- 它是一个新出现的数字

- 它是一个重复的数字,但是它的出现还不足K次

这个条件可以抽象概括为:

- 一个元素nums[j]可以被写入到nums[i]的位置,如果它和i左边第k个元素nums[i-k]不相等。

特殊边界情况:

- 当i<k时,说明有效数组长度还不足k,因此前k个元素应该被无条件保留。

class Solution(object):

def removeDuplicates(self, nums, k):

# 一个通用的解决方案,允许每个元素最多出现 k 次。

# i 是慢指针(或写指针/Writer)。

# nums[0...i-1] 是处理好的部分。

i = 0

# 使用 for 循环遍历每个元素,num 充当快指针(或读指针)的角色。

for num in nums:

# 核心判断条件:

# 1. 如果 i < k,说明当前处理好的数组长度还不足 k,

# 所以任何元素都可以直接放进来。

# 2. 如果 num > nums[i-k],说明当前元素 num 和结果数组中倒数第 k 个元素不同。

# 因为数组是排序的,这意味着我们还没有 k 个 num,所以可以把它放进来。

if i < k or num > nums[i - k]:

nums[i] = num

i += 1

return i

...

...

...

...

...

...

...

...

...

...

...

...

...

...

...

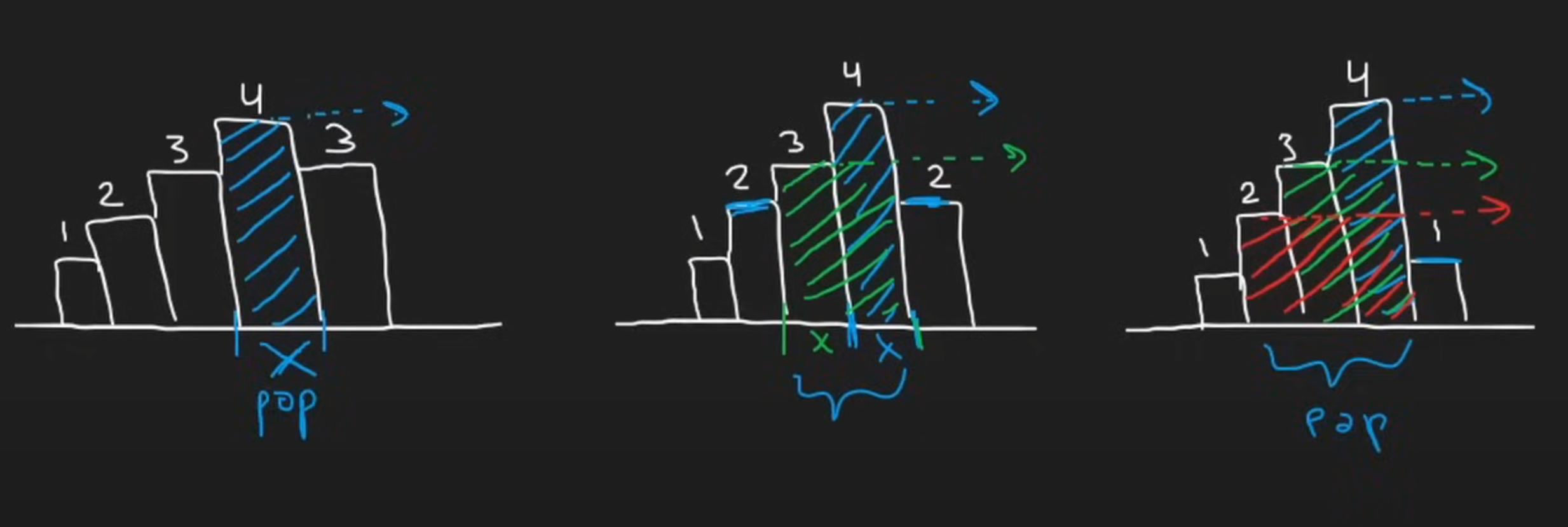

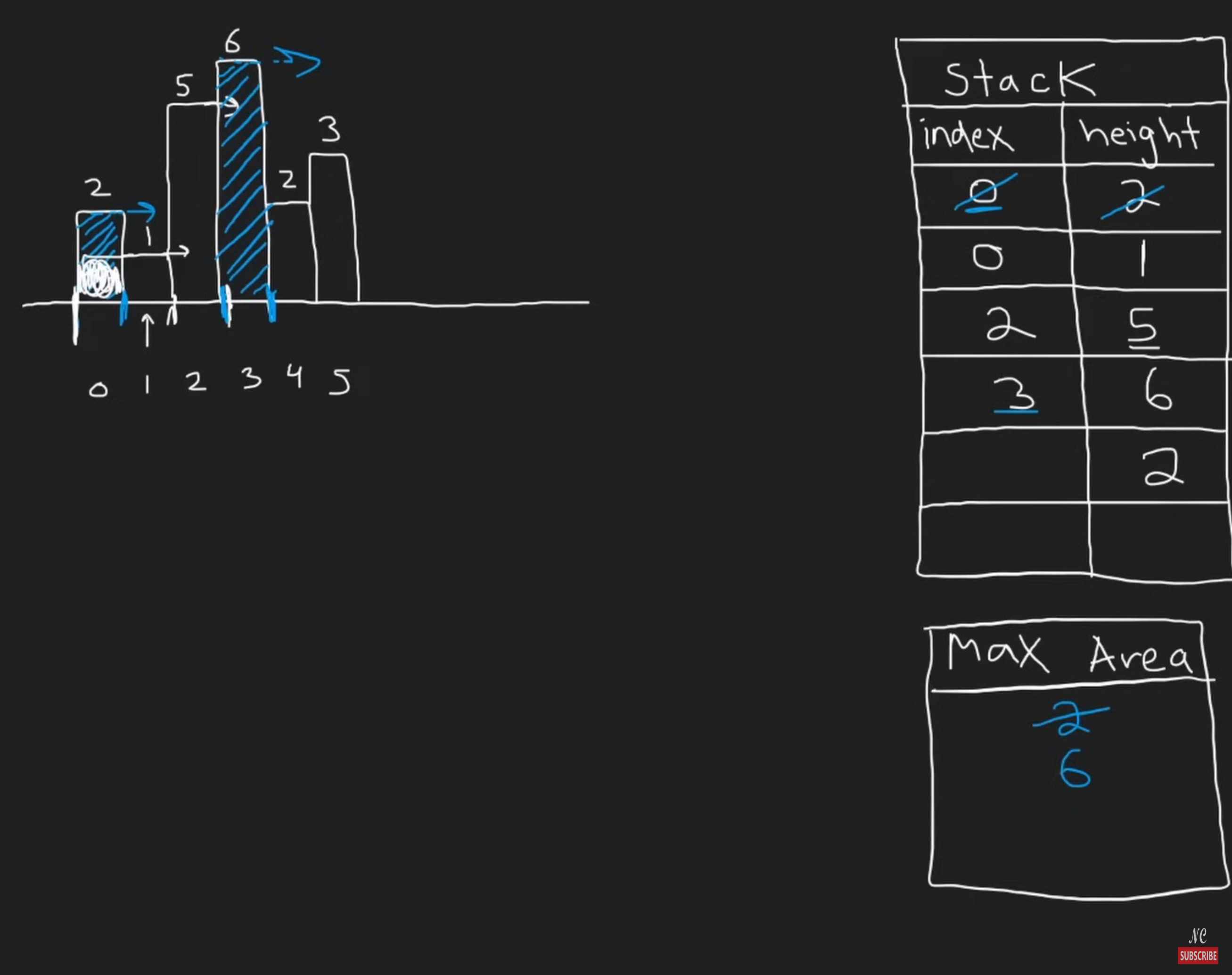

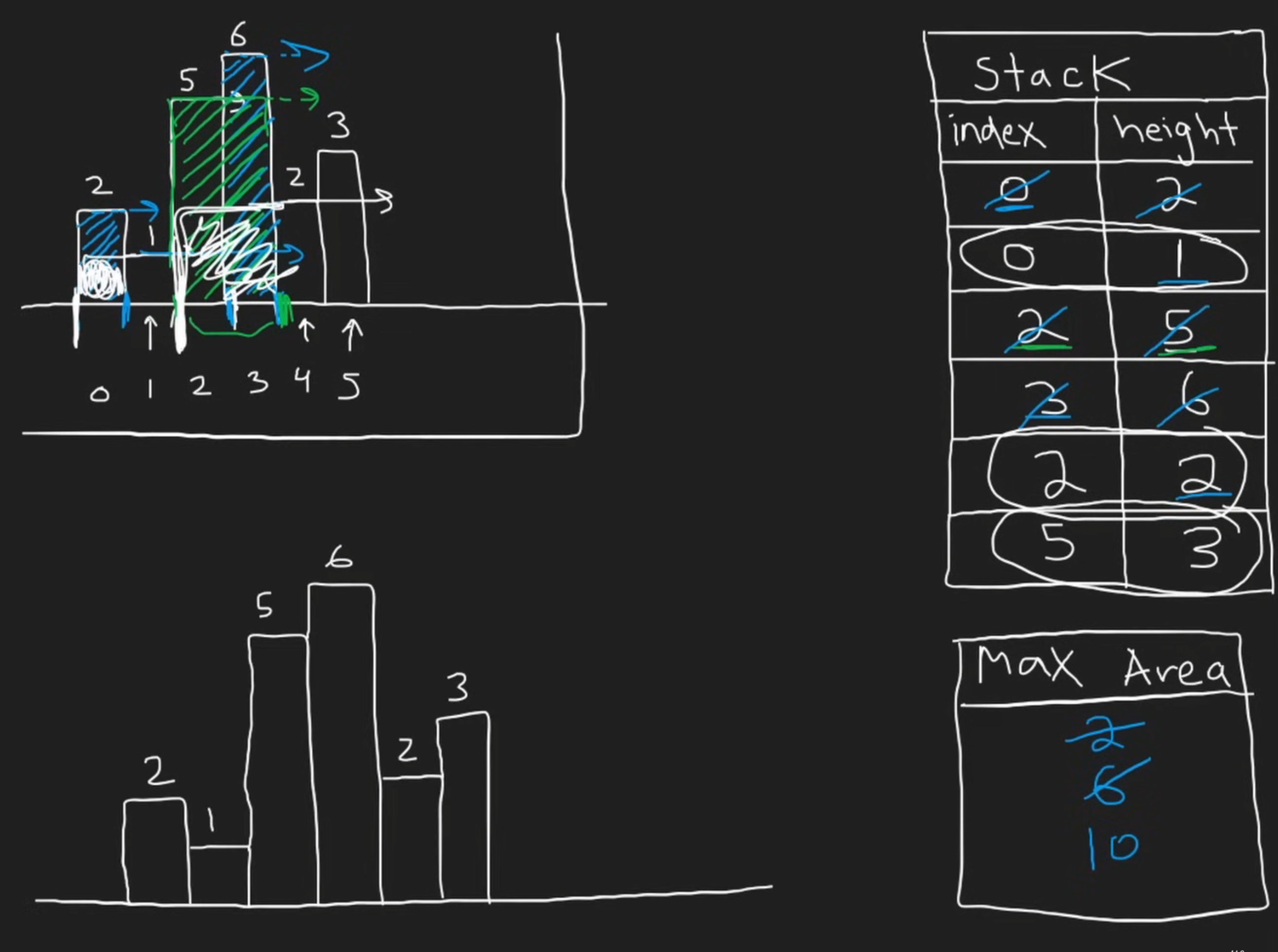

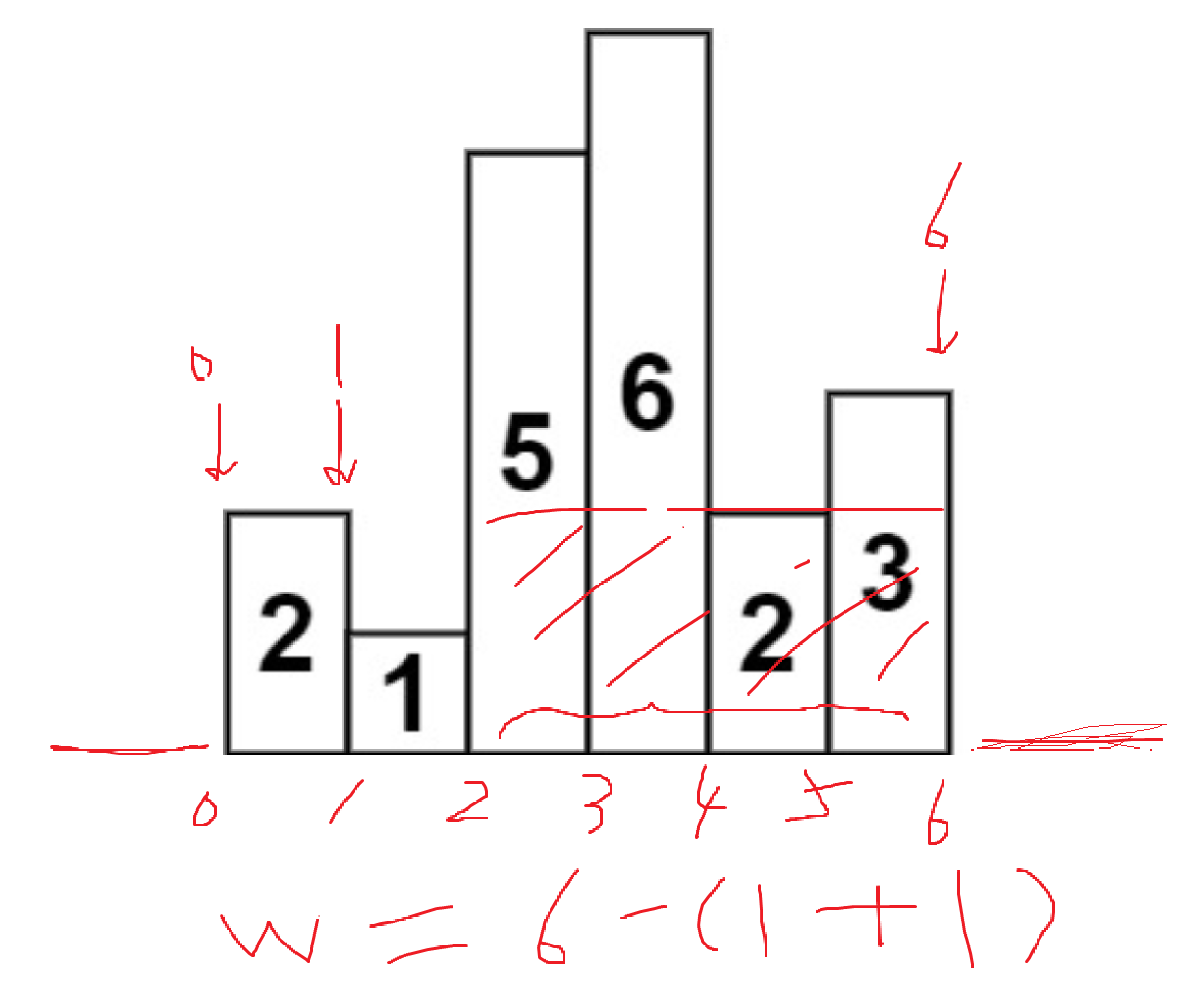

84. ※ Largest Rectangle in Histogram (Hard)

从左往右看,当出现更小的柱的时候,我们就不用再考虑之前的更高的柱了。

Neetcode的教程特别直观:

维护的时候:

- 增强节点,记录Index和height

- 当出现比top更高的height的时候,push into stack

- 当出现比top更矮的height的时候,一直pop到大于等于top;同时计算更新max_area,用height * (index_cur - index_top),然后边pop边计算,直到pop掉的大于等于top

到最后:

这个时候traverse完毕了,然后stack里还剩下几个element。这个时候按顺序从top开始计算,这个时候要注意,stack中所有的元素都要直接算到最后,因为还剩在stack里头就表示他们是可以一直延展到最后的。

那么怎么处理最后这一个柱子呢?一个非常聪明的做法就是添加哨兵,这样就不用最终单独处理了:

- 在heights后面添加一个高度为0的哨兵

- 在stack初始化的时候添加一个值为-1的哨兵,当只有一个元素计算的时候,减1再加1(宽度计算要index差值+1)后正好不加不减,等于那个柱子延伸到最左边的宽度(如果那个柱子是最矮的)

最后的最后,处理计算宽度的时候,很容易计算错误。这里我推荐用如下思路:

对于这种带有宽度的,统一把左下角的点看作是坐标轴上的点(即左边界),然后最后计算倒数第二个柱子也就是2的宽度的时候,是从最后的哨兵的左边界index - (柱子2的上一个更小的柱子1的index也就是1 + 1),这里加的1就是把1的index从左边界换到右边界,这样就非常清晰了。

...

...

88. Merge Sorted Array

Two pointers.

这道题逻辑简单,但是边界很容易写错:

class Solution(object):

def merge(self, nums1, m, nums2, n):

if not nums2:

return nums1

i = m - 1

j = n - 1

for k in range(len(m+n-1,-1,-1):

# 这里的边界判定很容易出错,导致index out of range error

if j < 0:

break

if i >= 0 and nums1[i] >= nums2[j]:

nums1[k] = nums1[i]

i -= 1

else:

nums1[k] = nums2[j]

j -= 1

return nums1

...

...

90. ※ Subsets II

这道题找不重复的子集,非常经典,强烈全文背诵加深刻理解。

我们完全从零开始,忘记之前的代码,只看题目。

目标:对于 [1, 2, 2],找出所有不重复的子集。

第一步:直面“重复”的根源

我们先把两个 2 区分开,记作 2a 和 2b。输入就是 [1, 2a, 2b]。

如果我们用最朴素的回溯法,会发生什么?

- 对于元素

1,我们可以选,也可以不选。 - 对于元素

2a,我们可以选,也可以不选。 - 对于元素

2b,我们可以选,也可以不选。

让我们看看子集中包含 1 的情况:

- 选

1,选2a,不选2b=> 得到{1, 2a} - 选

1,不选2a,选2b=> 得到{1, 2b} - 选

1,选2a,选2b=> 得到{1, 2a, 2b}

问题来了:在最终结果里,{1, 2a} 和 {1, 2b} 其实是同一个子集 [1, 2]。我们必须想办法 只生成其中一个 。

第二步:如何制定一个“唯一”的选择规则?

要避免重复,我们就得定个规矩,让所有重复的元素在选择时必须遵循同一种模式。 最容易想到的就是: 让相同的元素紧挨在一起 。这样我们才能方便地比较它们。

- 思考 :如何让相同元素挨在一起?

- 答案 :排序! 这是解决所有包含重复元素的排列组合问题的标准起手式。

排序后,输入依然是 [1, 2, 2]。

第三步:在决策树中发现重复模式

我们画一个简化的决策树来模拟回溯过程。

[]

/ \

/ \ (不选1)

[1] ...

/ \

(选第一个2)/ \ (不选第一个2)

/ \

[1, 2] [1] <-- 此时路径是[1],接下来要考虑第二个2

/ \

(选第二个2)/ \ (选第二个2)

/ \

[1, 2, 2] [1, 2] <-- 问题出现!

观察上图右侧的分支:

- 我们选择了

1。 - 然后我们跳过了第一个

2。 - 然后我们又选择了第二个

2。 这导致我们生成了子集[1, 2]。

再看上图左侧的分支:

- 我们选择了

1。 - 然后我们选择了第一个

2。 这也导致我们生成了子集[1, 2]。

重复的根源找到了 :对于相同的元素(例如两个 2),我们既可以“选择第一个,跳过第二个”,也可以“跳过第一个,选择第二个”,这两种不同的选择路径,最终得到了相同的结果。

第四步:制定剪枝规则,砍掉重复路径

为了保证唯一性,我们必须在这两种路径中只选一种。哪种更自然? 规定:对于一串重复的数字,我们只允许从左到右依次选择。我们不允许“跳过前面的重复数,反而去选择后面的”。

这个规定如何翻译成代码逻辑?

当我们在 for 循环中遍历到 nums[i] 时:

我们要判断是否要“跳过”(continue)nums[i]。

根据我们的规定,跳过的条件是:

“我想要跳过前面的重复数,然后选择当前这个数”。—— 这是我们要禁止的行为。

所以,我们的剪枝规则应该是:

如果当前数字 nums[i] 和它前一个数字 nums[i-1] 相同,并且我们是在“跳过了 nums[i-1]”的决策路径上,那么我们也必须跳过 nums[i]。

在代码中,for i in range(start_index, len(nums)) 这个循环本身就包含了“选择”和“跳过”的逻辑。当 for 循环从 i-1 迭代到 i 时,本身就意味着我们结束了对 nums[i-1] 的所有决策(即“回溯”了),相当于在当前层级“跳过”了 nums[i-1]。

因此,我们的规则可以精确地写成:

if i > start_index and nums[i] == nums[i-1]

nums[i] == nums[i-1]:保证了我们正在处理重复元素。i > start_index:这是最精妙的部分!它保证了这个判断只在同一层递归的for循环中生效。如果i == start_index,说明nums[i]是当前这层递归中我们遇到的第一个元素,我们无论如何都应该考虑它,所以不能剪枝。只有当i比start_index大时,才意味着我们正在横向遍历决策树的同一层,此时nums[i-1]就是我们刚刚考虑过的、位于同一层的兄弟节点。

总结一下思考路径:

- 目标 :去重。

- 发现问题 :不排序的话,相同的元素

2a和2b会产生[1, 2a]和[1, 2b]这样的重复。 - 初步解决方案 :先 排序 ,让

[1, 2a, 2b]变成[1, 2, 2],把问题集中化。 - 深入分析 :画决策树,发现重复来源于“跳过第一个2,选择第二个2”这样的操作。

- 制定规则 :禁止这种操作。规定对于重复元素,只能从左到右选,不能跳着选。

- 代码化规则 :将规定翻译成

if i > start_index and nums[i] == nums[i-1]: continue,精准地砍掉产生重复的搜索分支。

代码中关键部分我已经专门写出,建议直接记忆,慢慢理解:

...

nums.sort()

def backtrack(start_index):

result.append(list(path))

for i in range(start_index, len(nums)):

if i > start_index and nums[i] == nums[i-1]:

continue

...

...

...

...

...

...

...

...

...

...

...

...

...

...

...

...

...

98. Validate BST

注意:一定要记住,BST中每一个节点左侧的所有节点,都比这个节点小!

因此在DFS的时候,同时传递两个参数:

- lower bound: 代表当前node可选范围的下界限

- upper bound: 代表当前node可选范围的上界限

那么如何维护这个上下界限呢?

我们可以如此相像,当我们从root走向root左边的子树的时候,子树中的所有元素都共同有一个已经确定的上界限:root的value。换句话说,进入左子树后,所有左子树的value都必须小于root的value。同理,进入右子树的时候,所有节点共同维护一个下界限,这个下界限就是root的value。

然后我们来看root的left node。当我们访问root的left node后,这个node右边的所有子节点,必须维护一个大于这个node的value的下界限。以此类推。

最佳实践:

def isValidBST(self, root: Optional[TreeNode]) -> bool:

def validate(node, low, high):

if not node:

return True

if not low < node.val < high:

return False

return validate(node.left, low, node.val) and validate(node.right, node.val, high)

return validate(root, -float('inf'), float('inf'))

最佳实践的注释说明:

# Definition for a binary tree node.

# class TreeNode:

# def __init__(self, val=0, left=None, right=None):

# self.val = val

# self.left = left

# self.right = right

import math # 导入 math 模块以使用 float('-inf') 和 float('inf')

class Solution:

def isValidBST(self, root: Optional[TreeNode]) -> bool:

"""

检查一个二叉树是否是有效的二叉搜索树 (BST)。

一个 BST 的定义:

1. 节点的左子树只包含小于当前节点的数。

2. 节点的右子树只包含大于当前节点的数。

3. 左右子树本身也必须是二叉搜索树。

4. 所有左子树节点的值 < 根节点的值 < 所有右子树节点的值。

这意味着每个节点的值都必须在其祖先节点设定的特定范围内。

"""

# 辅助递归函数,用于验证节点及其子树是否在给定范围内

# node: 当前正在检查的节点

# lower_bound: 当前节点及其子树中所有节点值必须大于的最小值

# upper_bound: 当前节点及其子树中所有节点值必须小于的最大值

def validate(node, lower_bound, upper_bound):

# 递归终止条件 1: 如果节点为空,则视为有效的 BST (空树始终是 BST)

if not node:

return True

# 检查当前节点的值是否违反了它的边界限制

# ※ 注意,这里必须一行写,因为检查是严格的

# 如果 node.val <= lower_bound,说明它不大于下限,违反了 BST 性质

# 如果 node.val >= upper_bound,说明它不小于上限,违反了 BST 性质

if not (lower_bound < node.val < upper_bound):

return False

# 递归检查左子树:

# 左子树的所有节点值都必须小于当前节点的值 (node.val)。

# 所以,当前节点的值 node.val 成为左子树的新的 `upper_bound`。

# `lower_bound` 保持不变,因为左子树的节点仍需满足它父节点的下限要求。

left_is_valid = validate(node.left, lower_bound, node.val)

# 递归检查右子树:

# 右子树的所有节点值都必须大于当前节点的值 (node.val)。

# 所以,当前节点的值 node.val 成为右子树的新的 `lower_bound`。

# `upper_bound` 保持不变,因为右子树的节点仍需满足它父节点的上限要求。

right_is_valid = validate(node.right, node.val, upper_bound)

# 只有当左右子树都有效时,当前节点及其子树才构成一个有效的 BST

return left_is_valid and right_is_valid

# 初始调用辅助函数

# 对于根节点,它最初没有数值上的上限或下限限制(除了整数范围)。

# 因此,我们将初始的 lower_bound 设为负无穷,upper_bound 设为正无穷,

# 这样根节点的值总是会落在 (-inf, +inf) 范围内,可以被正确检查。

return validate(root, float('-inf'), float('inf'))

...

100. Same Tree

略。

...

...

...

...

No.101 - No.150

...

102. Binary Tree Level Order Traversal

就是普通的BFS。

...

104. Max Depth

Tree基础教学题,详情参见数据结构知识。

...

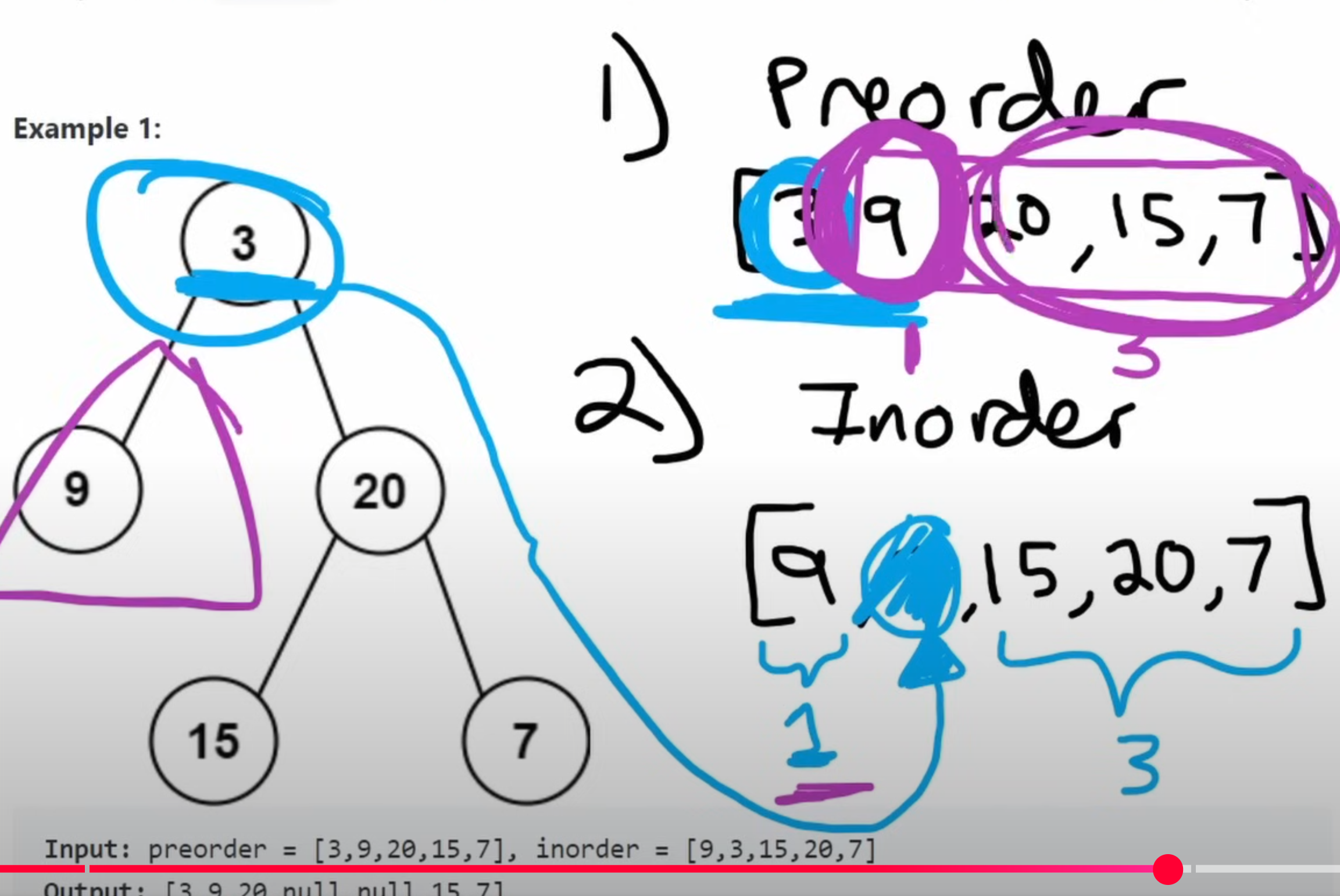

105. ※ Construct Binary Tree from Preorder and Inorder Traversal

根据已经有的结果来重建tree。

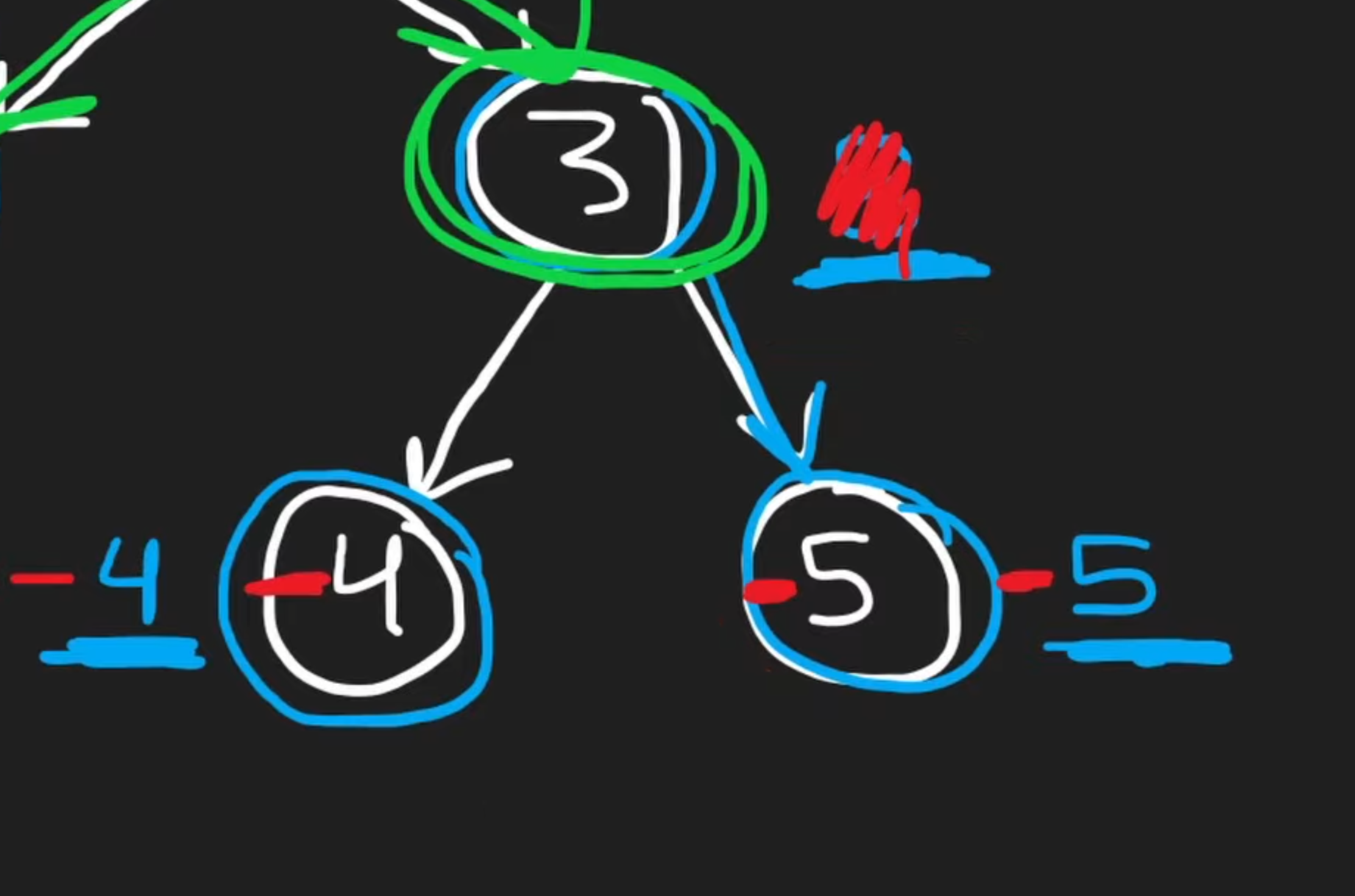

关键的点在于partition,如上图所示。(Neetcode教程链接)

我们可以直接在函数中进行递归:

- 导入参数为:preorder list和inorder list

- 首先判断两个list是否空了,如果空了,说明已经constructing完毕了。这里注意我们在recursion中return的是node,所以basecase的情况中return None,可以和node作为区分。

- 构建root node,这个总是preorder的第一个元素。

- 接着构建mid,这个一定是root node.val在Inorder中出现的地方。即上图中的蓝色箭头指向的内容。

- 有了mid后,我们就知道root的左子树和右子树了。这里我们对preorder进行分割,然后左子树的preorder和inorder这样就都有了。

- 分割后,我们就可以用递归,把左半部分的preorder/inorder导入左子树建设,把右半部分的preorder/inorder导入右子树建设。

- 最后直接return root就可以了。

代码如下:

def buildTree(self, preorder: List[int], inorder: List[int]) -> Optional[TreeNode]:

if not preorder and not inorder:

return None

root = TreeNode(preorder[0])

mid = inorder.index(preorder[0])

root.left = self.buildTree(preorder[1:1+mid],inorder[0:mid])

root.right = self.buildTree(preorder[1+mid:],inorder[mid+1:])

return root

这里的切片不太好记住,可以这么记:

- 首先root永远是preorder的第一个

- inorder中它的索引就是mid,这个mid就是尺子

- 记住:mid就是左子树的尺寸

- inorder切的时候:

- 左子树就是mid长度,也就是[0:mid]

- 右子树就是根mid右边的部分:[mid+1:]

- preorder切的时候:

- 左子树就是去掉头的mid长度:[1:1+mid]

- 右子树就是左子树后面的部分:[1+mid:]

或者在写代码的时候把这个结构图写在注释部分:

preorder: root, left, right

1

inorder: left, root, right

mid

然后用切片切。写切片的时候不要着急,这个不难,但是光动脑子想的话很容易写错。

以上是常规思路解法,但是其中有两个问题:

- inorder.index()这个操作需要从头到尾遍历inorder,时间复杂度是O(N)

- preorder[1:1+Mid]这种切片每次都会创建一个新的列表副本

针对上述两点,优化措施如下:

- 建立一个hashmap,创建value -> index的映射,这样可以用空间来换时间。

inorder_map = {val: i for i, val in enumerate(inorder)} - 递归函数增加参数索引index的传递

优化后的代码如下:(Leetcode beat 100%)

def buildTree(self, preorder: List[int], inorder: List[int]) -> Optional[TreeNode]:

inorder_map = {val: i for i, val in enumerate(inorder)}

# preorder 的索引,用来唯一确定当前的根节点

self.preorder_index = 0

def array_to_tree(left: int, right: int) -> Optional[TreeNode]:

# left: 当前子树在中序遍历中的左边界

# right: 当前子树在中序遍历中的右边界

# 基本情况:如果左边界大于右边界,说明当前是一个空子树

if left > right:

return None

# 2. 前序遍历的第一个元素就是当前的根节点

root_val = preorder[self.preorder_index]

root = TreeNode(root_val)

# 将 preorder 的索引后移一位,为构建子树做准备

self.preorder_index += 1

# 3. 从哈希表中 O(1) 获取根节点在中序遍历中的位置

inorder_root_index = inorder_map[root_val]

# 4. 递归构建左右子树

# 注意:必须先构建左子树,再构建右子树,这符合前序遍历的顺序

root.left = array_to_tree(left, inorder_root_index - 1)

root.right = array_to_tree(inorder_root_index + 1, right)

return root

# 初始调用,范围是整个中序遍历数组

return array_to_tree(0, len(inorder) - 1)

无论优化前后,算法都遵循着完全相同的、最根本的构建逻辑:

- 从

preorder确定根 :preorder数组的第一个元素永远是当前要构建的树(或子树)的根节点。 - 用

inorder划分左右 :在inorder数组中找到这个根节点,它左边的所有元素都属于左子树,右边的所有元素都属于右子树。 - 递归构建 :根据划分好的左右范围,递归地去构建左右子树。

这个 “ 分治 (Divide and Conquer) ” 的核心策略是这道题的灵魂,它在两个版本中是完全一致的。

变化在于我们如何高效地执行上面第二步和第三步。下面是一个直接的对比:

| 目标 (Goal) | 之前的做法 (Slicing Version) | 优化后的做法 (Index + Map Version) |

|---|---|---|

1. 查找根节点在 inorder中的位置 |

inorder.index()<br> 慢 ,每次查找都需要O(N)的线性扫描。 |

inorder_map[...]<br> 快 ,利用哈希表做到O(1)的即时查找。 |

| 2. 将子树问题交给下层递归 | 列表切片 preorder[...],inorder[...]<br> 笨重 ,每次都创建新列表,消耗大量时间和内存。 |

传递索引 (left, right)<br> 轻量 ,只传递两个数字,不产生任何额外的数据副本。 |

...

110. Balanced Binary Tree

Balanced的意思就是高度差1.

这里注意,python中False==0的结果判定是True,所以本道题中可以用-1来代表False。

...

112. Path Sum

这道题标简单但是对tree结构不太熟悉的话还真不好做。

这道题两种解法思路:

- 递归的时候不断把本层的val减去,这样到leaf的时候只要leaf和剩下的targetSum一致,就说明该path符合要求

- 单独建一个method,不断传递和,到leaf的时候对比sum是否和targetSum相等

....

...

...

121. ※ Best Time to Buy and Sell Stock I

这道题的关键是关注于两件事:

- 截至目前为止最低的价格

- 截至目前为止最高的利润

这道题建议一定要记住,因为这道题中的左指针是min_price,而不是常见的left。

min_price = float('inf')

max_profit = 0

for price in prices:

if price < min_price:

min_price = price

max_profit = max(max_profit, price - min_price)

return max_profit

122. Best Time to Buy and Sell Stock II

贪心直过,还没I难。

123. Best Time to Buy and Sell Stock III (Hard)

这次限制最多两次交易,难度上来了。需要用DP动态规划的思路。

我们先抛开动态规划的概念,来回归到这道题上来:假设你是一个手机倒卖小商贩,本金无限。现在,突然出现了一个限量款的手机,每个人只能拥有一部。你的目标是最多在这个市场里倒卖两次,然后赚到最多的钱。现在核心规则如下:

- 你的手里最多只能持有一部手机

- 必须先卖掉第一部,才能买入第二部

- 你最多只能完成两轮“买入-卖出”的交易

四个核心状态(你的四本账):想象你有四本账,分别记录不同阶段的最佳成果:

- 账本1 (

buy1):记录“第一次买入”后的最佳状态 - 含义 :只考虑第一次买入,你花掉的成本越少越好。这本账记录的是你“欠自己”最少的钱。

- 每天的决策 :看到今天的新价格,你问自己:“我是今天才第一次出手买呢,还是保持之前那个更便宜的买入价划算?”

- 例子 :第一天手机卖3000,你的账本1是

-3000。第二天手机降到2500,你就会想:“太好了,我应该按2500买才对!” 于是你把账本1更新为-2500。你总是在寻找最低的买入点。 - 账本2 (

sell1):记录“第一次卖出”后的最佳状态 - 含义 :只考虑完成第一笔交易后,你手里赚到的最多现金。

- 每天的决策 :看到今天的新价格,你问自己:“我是今天把它卖掉呢,还是保持之前某天卖掉赚的钱更多?”

- 例子 :你之前在2500买的(账本1是-2500)。今天手机涨到5000,你一卖,就能净赚

5000 - 2500 = 2500。如果之前某次交易的最高纪录是赚了2200,那你现在就把账本2更新为2500。 - 账本3 (

buy2):记录“第二次买入”后的最佳状态 - 含义 :在你完成第一笔交易赚到一笔钱后,你又出手买了第二部手机。这本账记录的是 “第一笔赚的钱 - 第二次买入的成本” 之后,你手里的“潜在总资产”。

- 每天的决策 :看到今天的新价格,你问自己:“我是在今天出手买第二部呢,还是保持之前那个‘买第二部后’的状态更有利?”

- 例子 :你第一笔交易净赚了2500(账本2是2500)。今天手机价格是4000,你决定买入第二部。那么你现在的总资产状态是

2500 (第一笔赚的) - 4000 (第二笔成本) = -1500。你把这个-1500记在账本3上。如果明天手机降到3800,你会更新账本3为2500 - 3800 = -1300,因为这个状态更有利。 - 账本4 (

sell2):记录“第二次卖出”后的最佳状态 - 含义 :完成所有两次交易后,你手里最终持有的总现金。这就是我们的终极目标!

- 每天的决策 :看到今天的新价格,你问自己:“我是今天卖掉第二部手机来锁定总利润呢,还是之前某次完成两笔交易的利润更高?”

- 例子 :你买第二部手机后的状态是-1300(账本3是-1300)。今天手机价格涨到了6000,你立刻卖掉。你的最终总利润就是

-1300 + 6000 = 4700。你把4700记在账本4上,这就是你目前为止倒卖两轮能赚到的最多钱。

class Solution:

def maxProfit(self, prices: list[int]) -> int:

# 初始化四个状态的利润

# buy1 和 buy2 初始化为一个极小值,确保第一次计算时会被当天的价格覆盖

buy1 = float('-inf')

sell1 = 0

buy2 = float('-inf')

sell2 = 0

# 遍历每一天的价格

for price in prices:

# 更新第一次买卖的最大利润

# max(保持前一天的buy1状态, 今天第一次买入)

buy1 = max(buy1, -price)

# max(保持前一天的sell1状态, 今天第一次卖出)

sell1 = max(sell1, buy1 + price)

# 更新第二次买卖的最大利润

# max(保持前一天的buy2状态, 基于sell1的利润今天第二次买入)

buy2 = max(buy2, sell1 - price)

# max(保持前一天的sell2状态, 今天第二次卖出)

sell2 = max(sell2, buy2 + price)

# 最终的最大利润就是sell2

# 如果不交易,sell2为0;如果只交易一次,sell2会等于sell1的最大值

return sell2

...

123S. Max Profit at Exactly Two Transactions

如果123的题目改成必须交易两次,那么在DP基础上稍作修改就可以了:

def maxProfitExactlyTwoTransactions(prices: list[int]) -> int:

# 检查价格序列是否足够长以完成两次交易

# 买卖一次需要2天,两次需要4天。

if len(prices) < 4:

# 在这种情况下,无法完成两次交易,可以根据题意返回0或错误。

# 但通常这类问题会保证输入长度足够。我们假设可以完成。

# 如果非要返回一个数字,负无穷代表“不可能”。

return -1 # 或者根据具体题目要求

# 初始化四个状态,强制每个状态都必须发生

buy1 = float('-inf')

sell1 = float('-inf') # 关键改动

buy2 = float('-inf')

sell2 = float('-inf') # 关键改动

for price in prices:

# 状态转移方程不变

buy1 = max(buy1, -price)

sell1 = max(sell1, buy1 + price)

buy2 = max(buy2, sell1 - price)

sell2 = max(sell2, buy2 + price)

# 最终的sell2就是必须完成两次交易后的最大利润

# 如果市场一直下跌,这个结果可能是负数

return sell2

...

124. Binary Tree Maximum Path Sum (Hard)

这道题的目标是找到和最大的那条路径。

这道题的难点在于,路径上可能会有负数,所以不能想当然的用一个左子树+右子树的和作为最大和路径的判断依据。

对于任何一个leaf node,其value就是该node往下看的path和。

然后我们把途中的3、4、5作为一个整体来看,因为只要弄明白3、4、5这个子部分的path和,就能知道从root出发的左子树和右子树的最大路径和。

从3往下看的话,我们必须知道从3往下看包括3的这一个子部分的最大路径和。为什么从3往下看呢?因为3作为一个分叉,要么从3到4,要么从3到5,只能二选一。

我们可以看到,这里出现了两个内容:

- 以3为root的子树的路径和,是4+3+5=12

- 从3往上连接的话,3作为被连接的一方,最大和是8

然后我们可以看到,3作为被连接的一方,和连接3的一方所组成的最大路径和是2+1+8=11,小于12。所以这个情况下他的最大路径和就是12。

可以看到,在递归的时候,我们必须处理两个事情:

- 以当前node为root的子树中最大的路径和

- 以当前node为连接,其可提供的最大路径和的加数

在计算可提供的最大路径和的加数的时候,我们还要注意负数,如果有负数的话:

遇到这种情况我们只需要在计算最大数的时候加上0:

- 以3为node的最大提供加数 = 3 + max(-4, -5, 0)

本题伪代码如下:

INPUT: root

result 存储最大和,初始化为root的value

DFS递归(node):

base case:node为空,return 0,因为空node提供不了加数

leftMax = dfs(node.left)

rightMax = dfs(node.right)

以node为根的左子树目前的最大和 leftMax = max(leftMax, 0)

同理,处理右子树可能为负的情况 rightMax = max(rightMax, 0)

计算path经过node的最大路径和 = node.val + leftMax + rightMax

对比该最大和与result,更新为更大的数字

最后将以node为加数的部分返回,供更上级调用

return node.val + max(leftMax, rightMax)

DFS(root)

return result

python代码如下:

class Solution(object):

def maxPathSum(self, root):

self.result = root.val # 作为实例变量存储

def dfs(node):

if not node:

return 0

leftMax = dfs(node.left)

rightMax = dfs(node.right)

leftMax = max(leftMax, 0)

rightMax = max(rightMax, 0)

self.result = max(self.result, leftMax + rightMax + node.val) # 访问实例变量

return node.val + max(leftMax, rightMax)

dfs(root)

return self.result

self.result或者result然后nonlocal声明都可以,本例和leetcode中推荐self.result。在同一个class内,self.result可以在所有的函数和任何函数内部的嵌套函数中访问,只要保证不重复设置self变量,那么就不会出现任何问题。

...

125. Valid Palindrome

初见:直接用python的 [::-1]暴力解。

时间:O(N), 空间:O(N)

用双指针法可以将空间优化到O(1):左右指针同时出发,对比有效字符。

...

128. ※※ Longest Consecutive Sequence

这道题要求O(N),也就是不能排序。

核心要点:对于一个数x,如何飞快地直到x+1在不在数组里?

解题方法:

将nums转换为一个set

遍历这个set:

判断(num-1)是否在set中;

如果不在,说明num就是一个连续序列的起点:

从num开始往后数,一直数到最后,记录连续数列的长度

更新longest

时间复杂度:

- 把nums转换为set需要O(N)

- 内部循环受限于数列长度也是O(N)

因此总的时间复杂度还是O(N)

空间复杂度:O(N)

注意,set中查找数字的平均情况是O(1),最差情况是O(N)

这道题的解法背后蕴含着一个非常重要的算法优化思想:通过增加空间复杂度来换取时间复杂度的降低,并识别“独立工作单元”以避免重复计算。

总结一下这两个思想:

- 空间换时间 (Space for Time Trade-off) :最朴素的想法可能是对每个数字都向两边搜索,时间复杂度会很高。我们引入哈希集合

set,将查找时间从 O(N) 降到了 O(1),这是一个典型的用空间(O(N) 的set)换时间(从 O(N2) 到 O(N))的案例。 - 识别起点,避免重复计算 (Identifying Starting Points to Avoid Redundant Work) :这是整个解法的精髓。我们没有盲目地对集合里的每一个数字都去计算它所在的连续序列长度。而是通过

if num - 1 not in numset这个聪明的判断,只对一个连续序列的“头” (例如[1, 2, 3, 4]中的1) 启动计算。对于序列中的其他元素 (2, 3, 4),我们直接跳过。这确保了每个连续序列,无论多长,其计数工作只会被执行 一次 。

这个思想可以概括为:对一个需要线性扫描的复杂问题,如果其中包含了大量重复或可预测的子任务,我们可以通过标记(通常用哈希表)来识别出每个任务的“唯一入口”或“起点”,从而保证每个任务只被完整执行一次。

这个“识别起点,避免重复计算”的思想在很多算法中都有体现,尤其是在图论和动态规划中。

应用案例:

- 图的遍历 (Graph Traversal - DFS/BFS)

- 问题 :遍历一个图,访问所有节点。

- 思想应用 :在进行深度优先搜索(DFS)或广度优先搜索(BFS)时,我们必须使用一个

visited集合(通常是哈希集合)来记录已经访问过的节点。当我们准备访问一个邻居节点时,会先检查它是否在visited集合中。如果在,就直接跳过。这和longestConsecutive中的if num - 1 in numset就跳过的逻辑异曲同工。它避免了在有环的图中无限循环,也保证了每个节点只被处理一次,从而将算法复杂度控制在 O(V+E)(V是顶点数,E是边数)。 - 单词拆分 (Word Break - LeetCode 139)

- 问题 :给定一个字符串

s和一个单词词典wordDict,判断s是否可以被拆分为一个或多个字典中出现的单词。 - 思想应用 :我们可以用动态规划或记忆化搜索来解决。定义一个函数

canBreak(index)表示字符串从index位置开始的后缀s[index:]能否被成功拆分。在函数内部,我们会尝试所有可能的单词匹配。如果没有优化,我们会反复计算canBreak对于同一个index的值。 - 这里的“起点”就是

index。我们可以用一个哈希表或数组memo来存储canBreak(index)的计算结果。在函数开头,先检查memo[index]是否已经计算过。如果计算过,直接返回结果。这完全符合我们“识别起点(index),避免重复计算”的思想。

...

...

131. ※ Palindrome Partitioning

这是一道经典的分割/分段模型题。(Segmentation Model)

这道题有点难,需要对input string进行多种可能的切割,和之前遇到的其他backtracking题都有点不一样。常规的回溯题是从元素集合中选择元素,每次分叉面临的选择是:选择哪个元素?

而这道题需要换个思维方式,在每一次选择的时候,选的不是元素,而是切的那一刀。遍历的不是元素,而是字符和字符之间的缝隙,在每个缝隙处,都要面临一个问题:切不切。

在此基础上,其实没必要每一个字符都切割。这道题是组合类问题,所以组合类问题就用start_index;但是这道题又不是普通的组合问题,因为所有可能的切割方法都要考察。所以在此基础上,我们从start_index开始,到字符串结束,访问每一个以start_index为起点的子字符串substring。即,尝试的是以start_index未开始,i为结束子字符串。

如果substring是一个回文,那么就把这一段切出来,然后把start_index设置为切完后的下一个字母。比如说'ababa',先找到了'a',以'b'为下一个start_index;这一轮recursion结束后,再回溯恢复,以'aba'为下一个回文子序列,进而继续遍历下一个可能的以第二个'b'作为下一个start_index。

class Solution(object):

def partition(self, s):

n = len(s)

result = [] # 用于存放所有有效分割方案的最终结果

path = [] # 用于存放当前正在探索的单个分割方案

# --- 步骤 1: 创建一个辅助函数来判断回文 ---

# 这个函数会按需被调用

def is_palin(sub):

# 一个非常简洁的 Python 写法,判断一个字符串是否和它的逆序相等

return sub == sub[::-1]

# --- 步骤 2: 核心回溯函数 ---

# start_index 表示当前需要处理的子串的起始位置

def backtrack(start_index):

# 基线条件 (Base Case):

# 如果起始位置已经到达了原字符串的末尾,

# 说明我们已经成功地将整个字符串分割完毕。

if start_index == n:

# 将当前路径的一个副本加入到结果集中。

# 必须是副本 (list(path)),否则后续 path 的修改会影响已存入 result 的结果。

result.append(list(path))

return

# --- 决策循环 ---

# 从 start_index 开始,尝试所有可能的切割终点 i

for i in range(start_index, n):

# 定义我们想要尝试切割的子串

substring = s[start_index : i + 1]

# 检查这个子串是否为回文

if is_palin(substring):

# 如果是回文,这是一个有效的选择

# 1. 做出选择 (Choose)

# 将这个有效的回文子串加入当前路径

path.append(substring)

# 2. 继续探索 (Explore)

# 从 i + 1 的位置开始,继续对字符串的剩余部分进行分割

backtrack(i + 1)

# 3. 撤销选择 (Unchoose / Backtrack)

# 当从上一层的递归调用返回后,我们需要撤销当前的选择,

# 以便 for 循环可以继续尝试其他的切割点 (比如尝试更长的子串)。

path.pop()

# 如果不是回文,for 循环会继续,i会增加,尝试一个更长的子串

# --- 步骤 3: 启动回溯 ---

# 从索引 0 开始,对整个字符串进行分割

backtrack(0)

return result

【最佳实践/最优解】在朴素的回溯中,我们会反复判断同一个子串是否是回文,比如处理'ababa'时,字串'aba'会被多次检查。为了避免这种冗余计算,我们可以预先计算出所有字串的回文属性,并将结果存储起来。这样在回溯的时候,判断一个字串是否是回文就从O(N)的复杂度变成了O(1)的查询操作。

class Solution(object):

def partition(self, s):

n = len(s)

# 如果字符串为空,直接返回空列表

if n == 0:

return []

# --- 步骤 1: 动态规划预处理 ---

# 创建一个 DP 表,dp[i][j] = True 表示子串 s[i..j] 是回文

# 初始化为 False

# 下面的部分等同于: dp = [[False] * n for _ in range(n)]

dp = [] # 先创建一个空列表

for _ in range(n): # 循环 n 次

# 每一次循环,都创建一个全新的行

row = [False] * n

# 把这一行加到 dp 列表中

dp.append(row)

# 填充 DP 表

# i 从右往左遍历,j 从 i 往右遍历,这样可以保证计算 dp[i][j] 时,

# 所依赖的 dp[i+1][j-1] 已经被计算过。

for i in range(n - 1, -1, -1):

for j in range(i, n):

# 如果 s[i] 和 s[j] 相等,则s[i..j]是否为回文取决于 s[i+1..j-1]

# 状态转移方程:dp[i][j] = (s[i] == s[j]) and (j - i < 2 or dp[i+1][j-1])

# j - i < 2 是处理边界情况:

# - j == i: 单个字符,必是回文

# - j == i + 1: 两个字符,相等即是回文

if s[i] == s[j] and (j - i < 2 or dp[i + 1][j - 1]):

dp[i][j] = True

# --- 步骤 2: 回溯搜索 ---

result = []

path = []

def backtrack(start_index):

if start_index == n:

result.append(list(path))

return

for i in range(start_index, n):

# [优化关键] 使用DP表进行 O(1) 的查询

# 如果 s[start_index..i] 不是回文,则这条路是死路,直接跳过(剪枝)

if not dp[start_index][i]:

continue

path.append(s[start_index : i + 1])

backtrack(i + 1)

path.pop()

backtrack(0)

return result

...

133. ※ Clone Graph

这是一道经典的adjacency list的教学题。但是注意,这道题使用的邻接表不是常见的hashmap + list,而是用Node来实现的。

"""

# Definition for a Node.

class Node:

def __init__(self, val = 0, neighbors = None):

self.val = val

self.neighbors = neighbors if neighbors is not None else []

"""

from typing import Optional

class Solution:

def cloneGraph(self, node: Optional['Node']) -> Optional['Node']:

if not node:

return None

hashmap = {} # old node: new node

def dfs(node):

if node in hashmap:

# mark

return hashmap[node]

newnode = Node(node.val)

if node not in hashmap:

hashmap[node] = newnode

# 上面已经处理完了映射关系

for neighbor in node.neighbors:

# neighbor是旧的

# 把neighbor加进去,这里如果过neighbor还不在hashmap中怎么办呢?

# ※ 答案就是这里继续dfs

new_neighbor = dfs(neighbor)

hashmap[node].neighbors.append(new_neighbor)

# return的是拷贝的值

return hashmap[node]

return dfs(node)

...

...

134. ※ Gas Station

这道题是一道经典的贪心greedy题,非常适合用来理解greedy思想。

本题要点:

- 设置一个总计数器,用来判断最终是否能符合条件

- 设置一个子计数器,用来判断哪个位置是合格的起点

...

135. ※ Candy (Hard)

这道题可以记一下贪心策略,以后可能会用上类似的思想:

- 从左到右贪心

- 从右到左贪心

...

136. Single Number

但其实这是一道bit manipulation题目,只有bit方法可以实现O(1) time & O(n) space.

这道题用的是XOR:

XOR 运算有两个关键属性非常适合这道题:

- 任何数和 0 进行异或运算,结果是其本身:a⊕0=a

- 任何数和其自身进行异或运算,结果是 0:a⊕a=0

from typing import List

def singleNumber_loop(nums: List[int]) -> int:

"""

使用 for 循环和 XOR 解决 "Single Number" 问题。

时间复杂度: O(n)

空间复杂度: O(1)

"""

result = 0

for num in nums:

# 使用 ^= 操作符进行异或运算

result ^= num

return result

# --- 示例 ---

print(f"输入 [2, 2, 1], 输出: {singleNumber_loop([2, 2, 1])}") # 输出: 1

print(f"输入 [4, 1, 2, 1, 2], 输出: {singleNumber_loop([4, 1, 2, 1, 2])}") # 输出: 4

print(f"输入 [1], 输出: {singleNumber_loop([1])}") # 输出: 1

...

...

...

138. Copy List with Random Pointer

这道题有两个方法:

- 最常见的,预设一个初始值为{None:None}的hashmap,预设这个初始值是防止cur.next为None的情况,会导致找不到None这个节点的问题。

- 不创建新的hashmap,空间复杂度为O(1),在每个node后面创建新node,建立好映射关系后再拆开。

...

139. ※ Word Break (Mark)

这道题乍一看没啥难的,结果提交了三次都Fail。最后发现测例子中有类似"cat", "cats"这种细微区别的子单词。因此这道题显然不能用常规的set解法,因为set一般搭配贪心策略,只能对当下的单词和字符进行处置,而无法处理cat, cats;and, sand这种相近单词做出有效区分。显然,对于这种出现cats的时候需要同时考虑cat或者cats的情况,我们需要考虑到未来的分布,这种情况下要么是回溯,要么是动态规划。

解法一:朴素回溯(更入门思路,但是会超时)

朴素回溯法”就是我们之前讨论的,最符合人类直觉的递归搜索方法。它不使用任何“备忘录”来记录中间结果,因此会对同一个子问题进行重复计算。

把问题看作一个决策树。从字符串的第一个字符开始,尝试所有可能的“第一步”(即匹配字典里的一个单词)。每成功匹配一个单词,就对剩余的字符串进行递归,这相当于深入树的一个分支。如果这个分支走到了死胡同(剩余的字符串无法再拆分),就“回溯”到上一个决策点,尝试另一个单词(另一个分支)。

class Solution:

def wordBreak_Backtracking(self, s: str, wordDict: list[str]) -> bool:

# 将字典转为集合,提高查找效率

word_set = set(wordDict)

# 这是我们的递归函数(回溯的核心)

def backtrack(start_index) -> bool:

"""

判断 s 从 start_index 开始的子串是否可以被拆分

"""

# 基本情况 (Base Case):如果起始索引已经到达字符串末尾,

# 说明前面的所有部分都成功匹配了,返回 True

if start_index == len(s):

return True

# 递归探索 (Recursive Step)

# 尝试从 start_index 开始的所有可能的结束位置

for end_index in range(start_index, len(s)):

# 截取当前的单词

current_word = s[start_index : end_index + 1]

# 如果这个单词在字典里

if current_word in word_set:

# 就继续对剩余部分进行回溯

# 如果后续的递归调用返回 True,说明找到了一条完整的路径

if backtrack(end_index + 1):

return True

# 如果所有可能的单词都尝试过了,都无法成功拆分剩余部分

# 说明从 start_index 开始的这条路是死胡同,返回 False

return False

# 从索引 0 开始,启动整个回溯过程

return backtrack(0)

但是,你可以想象一下这个例子:s = "aaaaaaaaab",wordDict = ["a", "aa", "aaa"]。

当你试图判断 s 能否拆分时,你会进行如下的探索:

- 尝试 "a",然后递归解决

s[1:]("aaaaaaaab")。 - 尝试 "aa",然后递归解决

s[2:]("aaaaaaab")。 - 尝试 "aaa",然后递归解决

s[3:]("aaaaaab")。

你会发现,要解决 s[1:],你可能又要先尝试 "a",然后去解决 s[2:]。看到了吗?“解决 s[2:] 能否被拆分” 这个子问题,被多次重复地遇到和计算。随着字符串变长,这种重复计算会呈指数级增长,导致严重的性能问题,在最坏情况下(例如 s="aaaaa", wordDict=["a", "aa", "aaa"]),决策树的分支会爆炸式增长,导致对同一个子问题(例如判断 s 的某个后缀能否拆分)进行大量重复计算,时间复杂度达到O(2^n),导致该方法不能作为一个通用解法。

解法二:动态规划(本题最佳解法)

动态规划通过“自底向上”地填表,系统性地解决了所有子问题,并确保每个子问题只计算一次。

核心思路:

创建一个 dp 数组,dp[i] 表示字符串 s 的前 i 个字符 s[0:i] 能否被成功拆分。从 dp[0] 开始,依次计算出 dp[1], dp[2], ..., 直到 dp[len(s)]。计算 dp[i] 时,我们会利用已经计算好的 dp[0] 到 dp[i-1] 的结果。

class Solution:

def wordBreak_DP(self, s: str, wordDict: list[str]) -> bool:

# 将字典转为集合,提高查找效率

word_set = set(wordDict)

n = len(s)

# dp[i] 表示 s 的前 i 个字符 s[0:i] 是否能被拆分

dp = [False] * (n + 1)

# base case: 空字符串总是可以被拆分的

dp[0] = True

# i 从 1 遍历到 n

for i in range(1, n + 1):

# j 从 0 遍历到 i-1

for j in range(i):

# 状态转移方程:

# 如果 s[0:j] 可以被拆分 (dp[j] is True)

# 并且 s[j:i] 这个单词在字典里

if dp[j] and s[j:i] in word_set:

# 那么 s[0:i] 就可以被拆分

dp[i] = True

# 找到一种方法即可,跳出内层循环

break

# 返回整个字符串的拆分结果

return dp[n]

通过两层嵌套循环解决问题。dp 数组确保了每个子问题 s[0:i] 是否能拆分只被计算一次。这是一个巨大的性能提升。时间复杂度是O(N^2),多项式级解法。

对于这道题,虽然朴素回溯法在逻辑上是通的,但由于存在大量的重叠子问题,它的性能是不可接受的。动态规划通过巧妙地存储和利用历史计算结果,将指数级的复杂度降为了多项式级,是解决这个问题的正确且高效的选择。

解法三:带备忘录的回溯法

实际上,还有一种介于两者之间的方法,叫做“带备忘录的回溯法” (Memoized Backtracking),它在朴素回溯的基础上增加一个“备忘录”数组来存储计算过的结果,从而避免重复计算。这种方法本质上就是“自顶向下”的动态规划,其时间和空间复杂度与“自底向上”的动态规划版本相同。

它的逻辑框架和朴素回溯法完全一样,都是通过递归去尝试各种可能性。唯一的区别是,我们增加了一个“备忘录”(一个数组或哈希表),用来记录已经计算过的子问题的结果。

执行流程如下:

- 当递归函数被调用,需要解决子问题

s[i:]能否被拆分时,首先去“备忘录”里查询。 - 如果查到了 :说明这个子问题之前就算过了,直接返回备忘录里存的结果,不再进行任何计算。

- 如果没查到 :说明这是第一次遇到这个子问题。那么就按照朴素回溯法原来的逻辑去计算。

- 在计算出结果(无论是

True还是False)后,在函数返回之前, 把这个结果存入备忘录 。这样下次再遇到同一个子问题时,就能在第 2 步直接查到了。

通过这个简单的“查表->计算->存表”的流程,我们保证了每个子问题(例如 s 从某个特定索引开始的后缀能否被拆分)都只会被实际计算一次。下面是带备忘录的回溯法代码。你可以和朴素回溯法的代码对比来看,会发现改动很小,但效果天差地别:

class Solution:

def wordBreak(self, s: str, wordDict: list[str]) -> bool:

word_set = set(wordDict)

# 1. 创建备忘录 (Memoization Table)

# memo[i] 用于存储 s[i:] 这个子串能否被成功拆分的结果。

# 我们用 None 表示“未计算”,True 表示“可以拆分”,False 表示“不可以拆分”。

memo = [None] * len(s)

def backtrack_with_memo(start_index: int) -> bool:

# 判断 s 从 start_index 开始的子串是否可以被拆分 (带有备忘录)

# Base Case: 成功到达字符串末尾

if start_index == len(s):

return True

# 2. 检查备忘录

# 如果该子问题已经计算过,直接返回存储的结果

if memo[start_index] is not None:

return memo[start_index]

# --- 以下的核心逻辑与朴素回溯完全相同 ---

for end_index in range(start_index, len(s)):

current_word = s[start_index : end_index + 1]

if current_word in word_set:

# 递归调用,如果后续部分可以拆分...

if backtrack_with_memo(end_index + 1):

# 3. 记录结果到备忘录

# 找到了一个解,将 True 存入备忘录并返回

memo[start_index] = True

return True

# 3. 记录结果到备忘录

# 如果循环结束都没找到解,说明此路不通

# 将 False 存入备忘录并返回

memo[start_index] = False

return False

# 从索引 0 开始启动回溯

return backtrack_with_memo(0)

...

...

141. Linked List Cycle

这道题引申出了一个非常经典的算法:弗洛伊德龟兔赛跑双指针法。双指针不仅可以找到是否有cycle,还能找到cycle的入口和cycle的长度。

142. Linked List Cycle II

这道题用的还是141的弗洛伊德龟兔赛跑双指针。

# Definition for singly-linked list.

# class ListNode(object):

# def __init__(self, x):

# self.val = x

# self.next = None

class Solution(object):

def detectCycle(self, head):

"""

:type head: ListNode

:rtype: ListNode

"""

slow, fast = head, head

# 步骤 1: 判断是否有环,并找到相遇点

# fast 走两步, slow 走一步

while fast and fast.next:

fast = fast.next.next

slow = slow.next

if slow == fast:

# 找到相遇点,跳出循环

break

else:

# 如果循环正常结束 (不是 durch break),说明 fast 走到了链表末尾

# 这意味着链表无环

return None

# 步骤 2: 找到环的入口

# 将一个指针(比如 slow)重置回头节点

slow = head

# 两个指针都以相同速度(一步)前进,直到它们再次相遇

# 它们再次相遇的节点就是环的入口

while slow != fast:

slow = slow.next

fast = fast.next

return slow

为什么当他们相遇后,我们把一个指针放回起点 (head),然后两个指针都用慢速(每次 1 步)前进,再次相遇的地方就一定是环的入口呢?

我们来做一点简单的数学分析。